单目标跟踪、多目标跟踪、单目标跟踪发展现状、多目标跟踪发展现状

单目标跟踪与多目标跟踪

- 单目标跟踪

-

- 定义:

- 基本流程:

- 方法分类:(根据观测模型是生成式模型或判别式模型)

-

- 生成式方法(Generative Method)

-

- 稀疏编码

- 判别式方法(Discriminative Method)

-

- 相关滤波

- 深度学习

单目标跟踪

定义:

单目标跟踪在每张图片中只跟踪一个目标。视觉目标(单目标)跟踪任务即根据所跟踪的视频序列给定初始帧(第一帧)的目标状态(位置、尺度),预测后续帧中该目标状态。基本结构(框架)如下:

单目标跟踪 (SOT) 领域内更多地侧重解决一个general obejct tracking (ID-unavailabe) 的问题,对从未在训练集中出现过的目标我们也希望能持续地跟踪上。

基本流程:

输入初始帧(第一帧)并初始化目标框(第一个图中的红框(从左往右)),在下一帧中产生众多候选框(产生有可能的目标框),提取这些候选框的特征(特征提取),然后对这些候选框评分(计算候选框的置信分数),最后在这些评分中找一个得分最高的候选框作为预测的目标(max{置信分数}),或者对多个预测值进行融合(Ensemble)得到更优的预测目标。

方法分类:(根据观测模型是生成式模型或判别式模型)

生成式方法(Generative Method)

稀疏编码

稀疏表示(Sparse Representation):用较少的基本信号的线性组合来表达大部分或者全部的原始信号。基于稀疏表示的目标跟踪方法则将跟踪问题转化为稀疏逼近问题来求解。

判别式方法(Discriminative Method)

相关滤波

相关滤波源于信号处理领域,相关性用于表示两个信号之间的相似程度,通常用卷积表示相关操作。基于相关滤波的跟踪方法的基本思想就是,寻找一个滤波模板,让下一帧的图像与我们的滤波模板做卷积操作,响应最大的区域则是预测的目标。其流程为:候选样本获取、特征提取、目标定位、模型更新。

(1)最小输出误差平方和跟踪算法(MOSSE)

MOSSE算法采用灰度特征,根据上一帧目 标位置提取目标候选区域,通过构造相关滤波器 实现目标跟踪,并在频域加速计算。

(2)核相关滤波跟踪算法(KCF)

KCF算法在MOSSE算法的基础上,采用具有多维数据的方向梯度直方图(HOG)特征,利用循环移位采样构造密集样本,克服了MOSSE算法训练样本过少的问题,加入正则化项,防止相关滤波器过拟合,完成了相关滤波跟踪算法基本框架的搭建.

(3)空间正则化相关滤波跟踪算法(SRDCF)

采用较大的目标搜索区域,利用从中心区域到边缘区域平滑增大的滤波器系数约束权重,对远离中心区域的滤波器系数进行惩罚,使相关滤波器主要关注于样本的中心区域、忽略样本的边缘区域,从而抑制边界效应。(算法目的:实现对边界效应的抑制)

(4)基于时空正则化的相关滤波跟踪算法(STRCF)

利用时间 正则化近似多幅图像情况,将基于多幅图像的训练有效简化为基于单幅图像的训练,使得算法可利用交替方向乘子法对相关滤波器系数进行求 解,提高了跟踪速度。该方法相对 SRDCF 算法而言,大大降低了计算复杂度,但其仍沿用固定的空间正则化系数,不能根据跟踪的目标进行灵活调整。

(5)基于自适应空间正则化的相关滤波跟踪算法(ASRCF)

该算法联合训练滤波器系数和约束权重,使得约束权重能根据目标外观变化及时进行调整,更有针对性地抑制低可靠性区域的滤波器系数。针对预设空间约束权重先验性强、不能良好适应未知应用场景的问题。

(6)有限边界相关滤波跟踪算法(LBCF)

采用小尺寸相关滤波器,通过掩膜矩阵对其隐性补零扩 充,使相关滤波器能部分忽略循环移位样本的边界区域,在一定程度上缓解边界效应

(7)基于通道和空间可靠性的相 关滤波跟踪算法(CSR_DCF)

利用颜色直方图信息对图像的空间可靠性进行 判断,根据空间可靠性生成二进制掩膜矩阵,利用该矩阵对相关滤波器系数进行限制。该方法本质上也是一种空间正则化方法,但由于采用了由 0,1 组成的约束权重,使其既克服了边界效应, 也隐性打破了目标搜索区域矩形框形状预设的限制。

(8)无监督深度跟踪算法(UDT)

利用大规模无标注视频数据对深度卷积神经网络进行无监督训练,使其更贴合跟踪任务。该算法基于稳健跟踪器的前向跟踪和后向跟踪应同时可靠的预设,在孪生相关滤波网络基础上,采用多帧验证方法和对代价敏感的损失函数训练网络,使网络提取的深度特征更适合目标跟踪。

(9)群特征选择相关滤波跟踪算法 (GFS-DCF)

根据多通道特征的空间一致性,跨越空间维度和特征通道维度进行群特征选择,学习具有空间-通道群稀疏性的相关滤波器,实现了从空间维度和特征通道维度对特征进行压缩.

(10)尺度空间判别跟踪算法 (DSST)

利用二维平移相关滤波器确定目标位置,然后在此基础上,构造具有33个尺度的图像金字塔,利用一维尺度相关滤波器进行检测,根据尺度相关滤波器最大响应值确定目标尺寸

(11)多特征自适应尺度跟踪算法(SAMF)

首先构造具有7个尺度的图像金字塔, 然后利用相关滤波器检测,根据目标响应最大值,同时确定目标的位置和尺寸。

(12)多线索相关滤波跟踪算法 (MCCT)

根据不同特征组合构成多专家跟踪系统,通过多专家间分歧大小确定跟踪结果置信度,分歧小时,表明跟踪结果可靠性高。

(13)互补学习跟踪算法 (Staple)

将基于颜色直方图的跟踪模型和 基于 HOG 特征的相关滤波跟踪模型融合。

(14)基于卷积残差学习的视觉跟 踪算法(CREST)

将相关滤波器转化为一个深度神经网络卷积层,通过空间域卷积操作实现相关性运算,避免了样本周期性假设和循环移位采样,从根本上消除了边界效应;相关滤波卷积层 完全可微分,通过网络单向传播更新相关滤波器,克服了经验插值更新方式难以在模型自适应和稳定性之间取得良好平衡的问题;利用残差学习获取目标的外观变化,有效缓解了目标显著外观变化导致的模型快速退化问题。

(15)相关滤波网络跟踪算法 (DCFNet)

该算法将相关滤波器视作添加在孪生网络后的一个特殊网络层,该层输出定义为目标位置概率图,模型更新通过该层反向传 播实现,深度特征提取和相关滤波跟踪可端到端进行训练。由于相关滤波网络层的反向传播仍然通过频域中的点乘运算实现,该算法即保留了相关滤波跟踪算法的高效性,也受益于网络端到端训练。

(16)基于空间对齐的相关滤波网络(SACFNet)

该算法利用空间对准模块的空间对齐功能,将目标从边界区域转换到具有标准化纵 横比的区域中心,缩小目标搜索空间,有效应对了边界效应和目标纵横比变化。

深度学习

同于检测、识别等视觉领域深度学习一统天下的趋势,深度学习在目标跟踪领域的应用并非一帆风顺。其主要问题在于训练数据的缺失:深度模型的魔力之一来自于对大量标注训练数据的有效学习,而目标跟踪仅仅提供第一帧的bounding-box作为训练数据。这种情况下,在跟踪开始针对当前目标从头训练一个深度模型困难重重。

深度学习的特点在于其特征提取能力,可以通过大量的数据训练,提取比传统方法更好的能够代表目标的特征。基于深度学习的跟踪可以分为:

(1)对相关滤波算法改进:C-COT、ECO。

(2)利用辅助图片数据预训练深度模型,在线跟踪时微调:DLT、SO-DLT。

(3)利用现有大规模分类数据集预训练的CNN分类网络提取特征:FCNT。

(4)利用跟踪序列预训练,在线跟踪时微调:MDNet

(5)运用递归神经网络进行目标跟踪的新思路:RTT、DeepTracking

利用辅助图片数据预训练深度模型,在线跟踪时微调

在目标跟踪的训练数据非常有限的情况下,使用辅助的非跟踪训练数据进行预训练,获取对物体特征的通用表示(general representation ),在实际跟踪时,通过利用当前跟踪目标的有限样本信息对预训练模型微调(fine-tune), 使模型对当前跟踪目标有更强的分类性能,这种迁移学习的思路极大的减少了对跟踪目标训练样本的需求,也提高了跟踪算法的性能。

这个方面代表性的作品有DLT和SO-DLT,都出自香港科技大学王乃岩博士。

DLT

DLT是第一个把深度模型运用在单目标跟踪任务上的跟踪算法。它的主体思路如上图所示:

(1) 先使用栈式降噪自编码器(stacked denoising autoencoder,SDAE)在Tiny Images dataset这样的大规模自然图像数据集上进行无监督的离线预训练来获得通用的物体表征能力。预训练的网络结构如上图(b)所示,一共堆叠了4个降噪自编码器, 降噪自编码器对输入加入噪声,通过重构出无噪声的原图来获得更鲁棒的特征表达能力。SDAE1024-2560-1024-512-256这样的瓶颈式结构设计也使获得的特征更加compact。

(2) 之后的在线跟踪部分结构如上图©所示,取离线SDAE的encoding部分叠加sigmoid分类层组成了分类网络。此时的网络并没有获取对当前被跟踪物体的特定表达能力。此时利用第一帧获取正负样本,对分类网络进行fine-tune获得对当前跟踪目标和背景更有针对性的分类网络。在跟踪过程中,对当前帧采用粒子滤波(particle filter)的方式提取一批候选的patch(相当于detection中的proposal),这些patch输入分类网络中,置信度最高的成为最终的预测目标。

(3) 在目标跟踪非常重要的模型更新策略上,该论文采取限定阈值的方式,即当所有粒子中最高的confidence低于阈值时,认为目标已经发生了比较大的表观变化,当前的分类网络已经无法适应,需要进行更新。

小结:DLT作为第一个将深度网络运用于单目标跟踪的跟踪算法,首先提出了“离线预训练+在线微调”的思路,很大程度的解决了跟踪中训练样本不足的问题,在CVPR2013提出的OTB50数据集上的29个跟踪器中排名第5。

但是DLT本身也存在一些不足:

(1) 离线预训练采用的数据集Tiny Images dataset只包含32*32大小的图片,分辨率明显低于主要的跟踪序列,因此SDAE很难学到足够强的特征表示。

(2) 离线阶段的训练目标为图片重构,这与在线跟踪需要区分目标和背景的目标相差甚大。

(3) SDAE全连接的网络结构使其对目标的特征刻画能力不够优秀,虽然使用了4层的深度模型,但效果仍低于一些使用人工特征的传统跟踪方法如Struck等。

SO-DLT(arXiv2015)

SO-DLT延续了DLT利用非跟踪数据预训练加在线微调的策略,来解决跟踪过程中训练数据不足的问题,同时也对DLT存在的问题做了很大的改进。

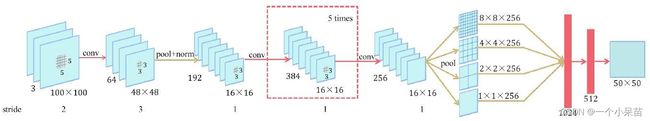

(1) 使用CNN作为获取特征和分类的网络模型。如上图所示,SO-DLT使用了的类似AlexNet的网络结构,但是有几大特点:一、针对跟踪候选区域的大小将输入缩小为100100,而不是一般分类或检测任务中的224224。 二、网络的输出为5050大小,值在0-1之间的概率图(probability map),每个输出像素对应原图22的区域,输出值越高则该点在目标bounding-box中的概率也越高。这样的做法利用了图片本身的结构化信息,方便直接从概率图确定最终的bounding-box,避免向网络输入数以百计的proposal,这也是SO-DLT structured output得名的由来。三、在卷积层和全连接层中间采用SPP-NET中的空间金字塔采样(spatial pyramid pooling)来提高最终的定位准确度。

(2) 在离线训练中使用ImageNet 2014的detection数据集使CNN获得区分object和非object(背景)的能力。

(1) 使用CNN作为获取特征和分类的网络模型。如上图所示,SO-DLT使用了的类似AlexNet的网络结构,但是有几大特点:

一、针对跟踪候选区域的大小将输入缩小为100100,而不是一般分类或检测任务中的224224。

二、网络的输出为5050大小,值在0-1之间的概率图(probability map),每个输出像素对应原图22的区域,输出值越高则该点在目标bounding-box中的概率也越高。这样的做法利用了图片本身的结构化信息,方便直接从概率图确定最终的bounding-box,避免向网络输入数以百计的proposal,这也是SO-DLT structured output得名的由来。

三、在卷积层和全连接层中间采用SPP-NET中的空间金字塔采样(spatial pyramid pooling)来提高最终的定位准确度。

(2) 在离线训练中使用ImageNet 2014的detection数据集使CNN获得区分object和非object(背景)的能力。

SO-DLT在线跟踪的pipeline如上图所示:

(1) 处理第t帧时,首先以第t-1帧的的预测位置为中心,从小到大以不同尺度crop区域放入CNN当中,当CNN输出的probability map的总和高于一定阈值时,停止crop, 以当前尺度作为最佳的搜索区域大小。

(2) 选定第t帧的最佳搜索区域后,在该区域输出的probability map上采取一系列策略确定最终的bounding-box中心位置和大小。

(3) 在模型更新方面,为了解决使用不准确结果fine-tune导致的drift问题,使用了long-term 和short-term两个CNN,即CNNs和CNNl。CNNs更新频繁,使其对目标的表观变化及时响应。CNNl更新较少,使其对错误结果更加鲁棒。二者结合,取最confident的结果作为输出。从而在adaptation和drift之间达到一个均衡。

小结:SO-DLT作为large-scale CNN网络在目标跟踪领域的一次成功应用,取得了非常优异的表现:在CVPR2013提出的OTB50数据集上OPE准确度绘图(precision plot)达到了0.819, OPE成功率绘图(success plot)达到了0.602。远超当时其它的state of the art。

SO-DLT有几点值得借鉴:

(1) 针对tracking问题设计了有针对性的网络结构。

(2) 应用CNNS和CNNL用ensemble的思路解决update 的敏感性,特定参数取多值做平滑,解决参数取值的敏感性。这些措施目前已成为跟踪算法提高评分的杀手锏。

但是SO-DLT离线预训练依然使用的是大量无关联图片,作者认为使用更贴合跟踪实质的时序关联数据是一个更好的选择。

利用现有大规模分类数据集预训练的CNN分类网络提取特征

2015年以来,在目标跟踪领域应用深度学习兴起了一股新的潮流。即直接使用ImageNet这样的大规模分类数据库上训练出的CNN网络如VGG-Net获得目标的特征表示,之后再用观测模型(observation model)进行分类获得跟踪结果。这种做法既避开了跟踪时直接训练large-scale CNN样本不足的困境,也充分利用了深度特征强大的表征能力。这样的工作在ICML15,ICCV15,CVPR16均有出现。下面介绍两篇发表于ICCV15的工作。

FCNT(ICCV15)

作为应用CNN特征于物体跟踪的代表作品,FCNT的亮点之一在于对ImageNet上预训练得到的CNN特征在目标跟踪任务上的性能做了深入的分析,并根据分析结果设计了后续的网络结构。

FCNT主要对VGG-16的Conv4-3和Conv5-3层输出的特征图谱(feature map)做了分析,并得出以下结论:

(1) CNN 的feature map可以用来做跟踪目标的定位。

(2) CNN 的许多feature map存在噪声或者和物体跟踪区分目标和背景的任务关联较小。

(3) CNN不同层的特征特点不一。高层(Conv5-3)特征擅长区分不同类别的物体,对目标的形变和遮挡非常鲁棒,但是对类内物体的区分能力非常差。低层(Conv4-3)特征更关注目标的局部细节,可以用来区分背景中相似的distractor,但是对目标的剧烈形变非常不鲁棒。

(1) 对于Conv4-3和Conv5-3特征分别构建特征选择网络sel-CNN(1层dropout加1层卷积),选出和当前跟踪目标最相关的feature map channel。

(2) 对筛选出的Conv5-3和Conv4-3特征分别构建捕捉类别信息的GNet和区分distractor(背景相似物体)的SNet(都是两层卷积结构)。

(3) 在第一帧中使用给出的bounding-box生成热度图(heat map)回归训练sel-CNN, GNet和SNet。

(4) 对于每一帧,以上一帧预测结果为中心crop出一块区域,之后分别输入GNet和SNet,得到两个预测的heatmap,并根据是否有distractor决定使用哪个heatmap 生成最终的跟踪结果。

小结:FCNT根据对CNN不同层特征的分析,构建特征筛选网络和两个互补的heat-map预测网络。达到有效抑制distractor防止跟踪器漂移,同时对目标本身的形变更加鲁棒的效果,也是ensemble思路的又一成功实现。在CVPR2013提出的OTB50数据集上OPE准确度绘图(precision plot)达到了0.856,OPE成功率绘图(success plot)达到了0.599,准确度绘图有较大提高。实际测试中FCNT的对遮挡的表现不是很鲁棒,现有的更新策略还有提高空间。

Hierarchical Convolutional Features for Visual Tracking(ICCV15)

这篇是作者在2015年度看到的最简洁有效的利用深度特征做跟踪的论文。其主要思路是提取深度特征,之后利用相关滤波器确定最终的bounding-box。

这篇论文简要分析了VGG-19特征( Conv3_4, Conv4_4, Conv5_4 )在目标跟踪上的特性,得出的结论和FCNT有异曲同工之处,即:

(1) 高层特征主要反映目标的语义特性,对目标的表观变化比较鲁棒。

(2) 低层特征保存了更多细粒度的空间特性,对跟踪目标的精确定位更有效。

基于以上结论,作者给出了一个粗粒度到细粒度(coarse-to-fine)的跟踪算法即:

(1) 第一帧时,利用Conv3_4,Conv4_4,Conv5_4特征的插值分别训练得到3个相关滤波器。

(2) 之后的每帧,以上一帧的预测结果为中心crop出一块区域,获取三个卷积层的特征,做插值,并通过每层的相关滤波器预测二维的confidence score。

(3) 从Conv5_4开始算出confidence score上最大的响应点,作为预测的bounding-box的中心位置,之后以这个位置约束下一层的搜索范围,逐层向下做更细粒度的位置预测,以最低层的预测结果作为最后输出。具体公式如下:

小结:这篇文章针对VGG-19各层特征的特点,由粗粒度到细粒度最终准确定位目标的中心点。在CVPR2013提出的OTB50数据集上OPE准确度绘图达到了0.891,OPE成功率绘图达到了0.605,相较于FCNT和SO-DLT都有提高,实际测试时性能也相当稳定,显示出深度特征结合相关滤波器的巨大优势。但是这篇文章中的相关滤波器并没有对尺度进行处理,在整个跟踪序列中都假定目标尺度不变。在一些尺度变化非常剧烈的测试序列上如CarScale上最终预测出的bounding-box尺寸大小和目标本身大小相差较大。

以上两篇文章均是应用预训练的CNN网络提取特征提高跟踪性能的成功案例,说明利用这种思路解决训练数据缺失和提高性能具有很高的可行性。但是分类任务预训练的CNN网络本身更关注区分类间物体,忽略类内差别。目标跟踪时只关注一个物体,重点区分该物体和背景信息,明显抑制背景中的同类物体,但是还需要对目标本身的变化鲁棒。分类任务以相似的一众物体为一类,跟踪任务以同一个物体的不同表观为一类,使得这两个任务存在很大差别,这也是两篇文章融合多层特征来做跟踪以达到较理想效果的动机所在。

利用跟踪序列预训练,在线跟踪时微调

1和2中介绍的解决训练数据不足的策略和目标跟踪的任务本身存在一定偏离。有没有更好的办法呢?VOT2015冠军MDNet给出了一个示范。该方法在OTB50上也取得了OPE准确度绘图0.942,OPE成功率绘图0.702的惊人得分。

MDNet(CVPR2016)

Learning Multi-Domain Convolutional Neural Networks for Visual Tracking

意识到图像分类任务和跟踪之间存在巨大差别,MDNet提出直接用跟踪视频预训练CNN获得general的目标表示能力的方法。但是序列训练也存在问题,即不同跟踪序列跟踪目标完全不一样,某类物体在一个序列中是跟踪目标,在另外一个序列中可能只是背景。不同序列中目标本身的表观和运动模式、环境中光照、遮挡等情形相差甚大。这种情况下,想要用同一个CNN完成所有训练序列中前景和背景区分的任务,困难重重。

最终MDNet提出Multi-Domain的训练思路和如上图所示的Multi-Domain Network。该网络分为共享层和domain-specific层两部分。即:将每个训练序列当成一个单独的domain,每个domain都有一个针对它的二分类层(fc6),用于区分当前序列的前景和背景,而网络之前的所有层都是序列共享的。这样共享层达到了学习跟踪序列中目标general的特征表达的目的,而domain-specific层又解决了不同训练序列分类目标不一致的问题。

具体训练时,MDNet的每个mini-batch只由一个特定序列的训练数据构成,只更新共享层和针对当前序列的特定fc6层。这样共享层中获得了对序列共有特征的表达能力,如对光照、形变等的鲁棒性。MDNet的训练数据也非常有意思,即测试OTB100数据集时,利用VOT2013-2015的不重合的58个序列来做预训练。测试VOT2014数据集时,利用OTB100上不重合的89个序列做预训练。这种交替利用的思路也是第一次在跟踪论文中出现。

在线跟踪阶段针对每个跟踪序列,MDNet主要有以下几步:

(1) 随机初始化一个新的fc6层。

(2) 使用第一帧的数据来训练该序列的bounding box回归模型。

(3) 用第一帧提取正样本和负样本,更新fc4, fc5和fc6层的权重。

(4) 之后产生256个候选样本,并从中选择置信度最高的,之后做bounding-box regression得到最终结果。

(5) 当前帧最终结果置信度较高时,采样更新样本库,否则根据情况对模型做短期或者长期更新。

MDNet有两点值得借鉴之处:

(1) MDNet应用了更为贴合跟踪实质的视频数据来做训练,并提出了创新的Multi-domain训练方法和训练数据交叉运用的思路。

(2) 此外MDNet从检测任务中借鉴了不少行之有效的策略,如难例挖掘(hard negative mining),bounding box回归等。尤其是难例回归通过重点关注背景中的难点样本(如相似物体等)显著减轻了跟踪器漂移的问题。这些策略也帮助MDNet在TPAMI2015 OTB100数据集上OPE准确度绘图从一开始的0.825提升到0.908, OPE成功率绘图从一开始的0.589提升到0.673。

但是也可以发现MDNet的总体思路和RCNN比较类似,需要前向传递上百个proposal,虽然网络结构较小,速度仍较慢。且boundingbox回归也需要单独训练,因此MDNet还有进一步提升的空间。

运用递归神经网络进行目标跟踪的新思路

近年来RNN尤其是带有门结构的LSTM,GRU等在时序任务上显示出了突出的性能。不少研究者开始探索如何应用RNN来做解决现有跟踪任务中存在的问题,以下简要介绍两篇在这方面比较有代表性的探索文章。

RTT(CVPR16)

Recurrently Target-Attending Tracking

这篇文章的出发点比较有意思,即利用多方向递归神经网络(multi-directional recurrent neural network)来建模和挖掘对整体跟踪有用的可靠目标部分(reliable part),实际上是二维平面上的RNN建模,最终解决预测误差累积和传播导致的跟踪漂移问题。其本身也是对part-based跟踪方法和相关滤波(correlation filter)方法的改进和探索。

(1) 首先对每一帧的候选区域进行网状分块,对每个分块提取HOG特征,最终相连获得基于块的特征

![]()

(2) 得到分块特征以后,RTT利用前5帧训练多方向RNN来学习分块之间大范围的空间关联。

通过在4个方向上的前向推进,RNN计算出每个分块的置信度,最终每个块的预测值组成了整个候选区域的置信图(confidence map)。受益于RNN的recurrent结构,每个分块的输出值都受到其他关联分块的影响,相比于仅仅考虑当前块的准确度更高,避免单个方向上遮挡等的影响,增加可靠目标部分在整体置信图中的影响。

(3) 由RNN得出置信图之后,RTT执行了另外一条pipeline。即训练相关滤波器来获得最终的跟踪结果。值得注意的是,在训练过程中RNN的置信图对不同块的filter做了加权,达到抑制背景中的相似物体,增强可靠部分的效果。

(4) RTT提出了一个判断当前跟踪物体是否被遮挡的策略,用其判断是否更新。即计算目标区域的置信度和,并与历史置信度和的移动平均数(moving average)做一个对比,低于一定比例,则认为受到遮挡,停止模型更新,防止引入噪声。

小结:RTT是第一个利用RNN来建模part-based跟踪任务中复杂的大范围关联关系的跟踪算法。在CVPR2013提出的OTB50数据集上OPE准确度绘图为0.827,OPE成功率绘图达到了0.588。相比于其他基于传统特征的相关滤波器算法有较大的提升,说明RNN对关联关系的挖掘和对滤波器的约束确实有效。RTT受制于参数数目的影响,只选用了参数较少的普通RNN结构(采用HOG特征其实也是降低参数的另外一种折中策略)。结合之前介绍的解决训练数据缺失的措施,RTT可以运用更好的特征和RNN结构,效果还有提升空间。