动手学PyTorch | (9) 权重衰减

上⼀节中我们观察了过拟合现象,即模型的训练误差远⼩于它在测试集上的误差。虽然增⼤训练数据集可能会减轻过拟合,但是获取额外的训练数据往往代价⾼昂。本节介绍应对过拟合问题的常用⽅法:权衰减(weight decay)。

目录

1. 方法

2.高维线性回归实验

3. 从0开始实现

4. 简洁实现

5. 小结

1. 方法

权重衰减等价于![]() 范数正则化(regularization)。正则化通过为模型损失函数添加惩罚项使学出的模型参数值较小,是应对过拟合的常⽤⼿段。我们先描述

范数正则化(regularization)。正则化通过为模型损失函数添加惩罚项使学出的模型参数值较小,是应对过拟合的常⽤⼿段。我们先描述![]() 范数正则化,再解释它为何又称权重衰减。

范数正则化,再解释它为何又称权重衰减。

![]() 范数正则化在模型原损失函数基础上添加

范数正则化在模型原损失函数基础上添加![]() 范数惩罚项,从⽽得到训练所需要最⼩化的函数。

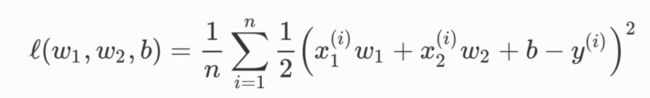

范数惩罚项,从⽽得到训练所需要最⼩化的函数。![]() 范数惩罚项指的是模型权参数每个元素的平方和与一个正的常数的乘积。以(线性回归)中的线性回归损失函数:

范数惩罚项指的是模型权参数每个元素的平方和与一个正的常数的乘积。以(线性回归)中的线性回归损失函数:

为例,其中![]() 是权重参数, b是偏差参数,样本i的输入特征为

是权重参数, b是偏差参数,样本i的输入特征为![]() ,标签为

,标签为![]() ,样本数为n。将权重参数用向量

,样本数为n。将权重参数用向量![]() 表示,带有

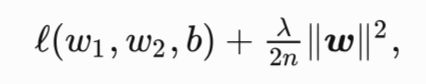

表示,带有![]() 范数惩罚项的新损失函数为:

范数惩罚项的新损失函数为:

其中超参数![]() .当权参数均为0时,惩罚项最小。当

.当权参数均为0时,惩罚项最小。当![]() 较大时,惩罚项在损失函数中的⽐较大,这通常会使学到的权重参数的元素较接近0.当

较大时,惩罚项在损失函数中的⽐较大,这通常会使学到的权重参数的元素较接近0.当![]() =0时,惩罚项完全不起作用。上式中

=0时,惩罚项完全不起作用。上式中![]() 范数平方

范数平方![]() 展开后得到

展开后得到![]() .有了

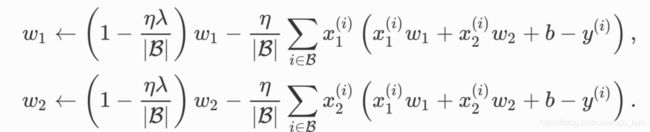

.有了![]() 范数惩罚项后,在小批量随机梯度下降中,我们将线性回归一节中权重

范数惩罚项后,在小批量随机梯度下降中,我们将线性回归一节中权重![]() 的迭代方式更改为:

的迭代方式更改为:

可见,![]() 范数正则化令权重

范数正则化令权重![]() 先⾃乘小于1的数,再减去不含惩罚项的梯度。因此,

先⾃乘小于1的数,再减去不含惩罚项的梯度。因此,![]() 范数正则化⼜叫权重衰减。权重衰减通过惩罚绝对值较大的模型参数为需要学习的模型增加了限制,这可能对过拟合有效。实际场景中,我们有时也在惩罚项中添加偏差元素的平⽅和。

范数正则化⼜叫权重衰减。权重衰减通过惩罚绝对值较大的模型参数为需要学习的模型增加了限制,这可能对过拟合有效。实际场景中,我们有时也在惩罚项中添加偏差元素的平⽅和。

2.高维线性回归实验

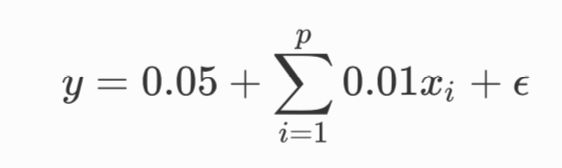

下⾯,我们以⾼维线性回归为例来引⼊一个过拟合问题,并使用权重衰减来应对过拟合。设数据样本特征的维度为p。对于训练数据集和测试数据集中特征为![]() 的任⼀样本,我们使⽤如下的线性函数来⽣成该样本的标签:

的任⼀样本,我们使⽤如下的线性函数来⽣成该样本的标签:

其中噪声项![]() 服从均值为0、标准差为0.01的正态分布。为了较容易地观察过拟合,我们考虑⾼维线性回归问题,如设维度p=200,同时,我们特意把训练数据集的样本数设低,如20。

服从均值为0、标准差为0.01的正态分布。为了较容易地观察过拟合,我们考虑⾼维线性回归问题,如设维度p=200,同时,我们特意把训练数据集的样本数设低,如20。

生成数据集:

%matplotlib inline

import torch

import torch.nn as nn

import numpy as np

import sys

sys.path.append(".")

import d2lzh_pytorch as d2l

n_train, n_test, num_inputs = 20, 100, 200

true_w, true_b = torch.ones(num_inputs, 1) * 0.01, 0.05

features = torch.randn((n_train + n_test, num_inputs))

labels = torch.matmul(features, true_w) + true_b

labels += torch.tensor(np.random.normal(0, 0.01, size=labels.size()), dtype=torch.float)

train_features, test_features = features[:n_train, :], features[n_train:, :]

train_labels, test_labels = labels[:n_train], labels[n_train:]

3. 从0开始实现

下⾯先介绍从零开始实现权重衰减的⽅法。我们通过在⽬标函数后添加L2范数惩罚项来实现权重衰减。

- 初始化模型参数

⾸先,定义随机初始化模型参数的函数。该函数为每个参数都附上梯度。

def init_params():

w = torch.randn((num_inputs, 1), requires_grad=True)

b = torch.zeros(1, requires_grad=True)

return [w, b]- 定义L2范数惩罚项

定义L2范数惩罚项,这里只惩罚模型的权重参数。

def l2_penalty(w):

return (w**2).sum() / 2- 定义训练和测试

下面定义如何在训练数据集和测试数据集上分别训练和测试模型。与前面几节中不同的是,这⾥在计算最终的损失函数时添加了L2范数惩罚项。

batch_size, num_epochs, lr = 1, 100, 0.003

net, loss = d2l.linreg, d2l.squared_loss

dataset = torch.utils.data.TensorDataset(train_features, train_labels)

train_iter = torch.utils.data.DataLoader(dataset, batch_size, shuffle=True)

def fit_and_plot(lambd):

w, b = init_params()

train_ls, test_ls = [], []

for _ in range(num_epochs):

for X, y in train_iter:

# 添加了L2范数惩罚项

l = loss(net(X, w, b), y) + lambd * l2_penalty(w)

l = l.sum()

if w.grad is not None:

w.grad.data.zero_()

b.grad.data.zero_()

l.backward()

d2l.sgd([w, b], lr, batch_size)

train_ls.append(loss(net(train_features, w, b), train_labels).mean().item())

test_ls.append(loss(net(test_features, w, b), test_labels).mean().item())

d2l.semilogy(range(1, num_epochs + 1), train_ls, 'epochs', 'loss',

range(1, num_epochs + 1), test_ls, ['train', 'test'])

print('L2 norm of w:', w.norm().item())#可以把这个函数保存在d21zh包里 方便以后使用

def linreg(X,w,b):

return X.mm(w)+b

#可以把这个函数保存在d21zh包里 方便以后使用

def squared_loss(y_hat,y):

#这里返回的是向量 另外pytorch中的mse loss没有除以2

return (y_hat-y.view(y_hat.size()))**2/2

#可以把这个函数保存在d21zh包里 方便以后使用

def sgd(params,lr,batch_size):

for param in params:

#param.data -= lr*param.grad/batch_size #注意这里更改param时使用的是param.data

param.data -= lr*param.grad/batch_size #注意这里更改param时使用的是param.data- 观察过拟合

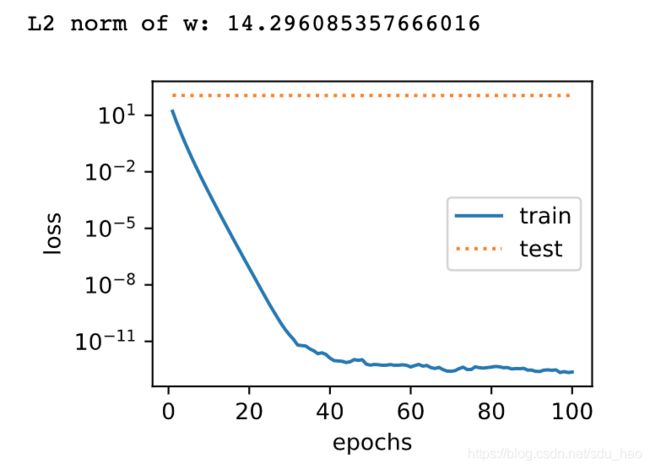

接下来,让我们训练并测试⾼维线性回归模型。当lambd设为0时,我们没有使⽤权重衰减。结果训练误差远⼩于测试集上的误差。这是典型的过拟合现象。

fit_and_plot(lambd=0)- 使用权重衰减

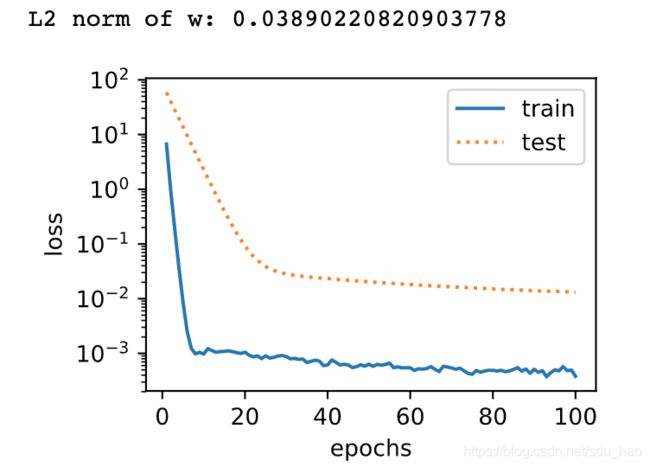

下⾯我们使⽤权重衰减。可以看出,训练误差虽然有所提高,但测试集上的误差有所下降。过拟合现象得到⼀定程度的缓解。另外,权参数的L2范数⽐不使用权衰减时的更小,此时的权参数更接近0。

fit_and_plot(lambd=3)4. 简洁实现

这⾥我们直接在构造优化器实例时通过weight_decay参数来指定权重衰减超参数。默认下,PyTorch会对权重和偏差同时衰减。我们可以分别对权重和偏差构造优化器实例,从⽽只对权重衰减。

def fit_and_plot_pytorch(wd):

# 对权重参数衰减。权重名称一般是以weight结尾

net = nn.Linear(num_inputs, 1)

#自定义参数初始化

nn.init.normal_(net.weight, mean=0, std=1)

nn.init.normal_(net.bias, mean=0, std=1)

optimizer_w = torch.optim.SGD(params=[net.weight], lr=lr, weight_decay=wd) # 对权重参数衰减

optimizer_b = torch.optim.SGD(params=[net.bias], lr=lr) # 不对偏差参数衰减

train_ls, test_ls = [], []

for _ in range(num_epochs):

for X, y in train_iter:

l = loss(net(X), y).mean()

optimizer_w.zero_grad()

optimizer_b.zero_grad()

l.backward()

# 对两个optimizer实例分别调用step函数,从而分别更新权重和偏差

optimizer_w.step()

optimizer_b.step()

train_ls.append(loss(net(train_features), train_labels).mean().item())

test_ls.append(loss(net(test_features), test_labels).mean().item())

d2l.semilogy(range(1, num_epochs + 1), train_ls, 'epochs', 'loss',

range(1, num_epochs + 1), test_ls, ['train', 'test'])

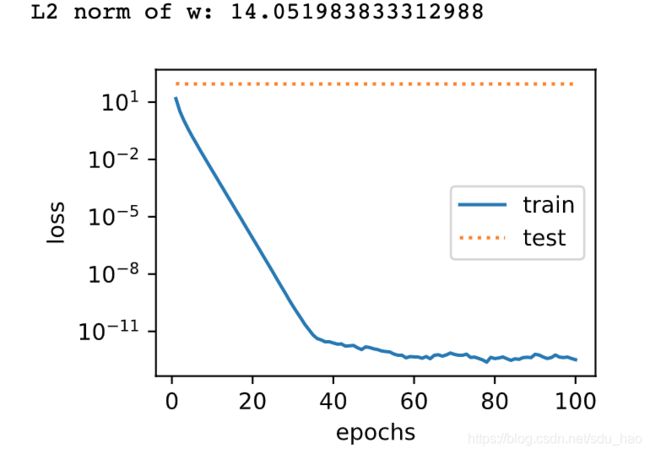

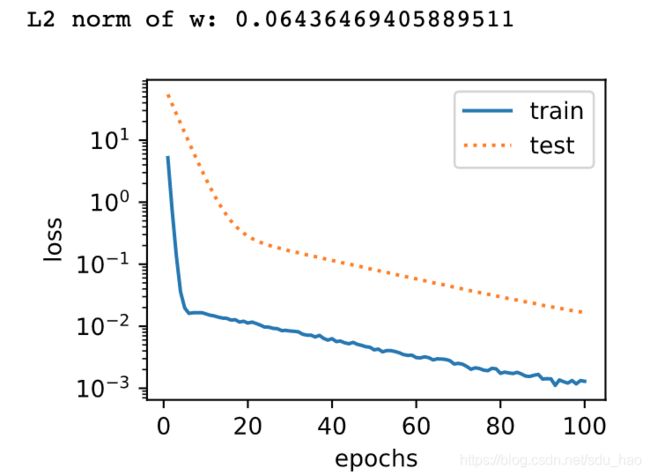

print('L2 norm of w:', net.weight.data.norm().item())与从零开始实现权重衰减的实验现象类似,使用权重衰减可以在一定程度上缓解过拟合问题。

fit_and_plot_pytorch(0)fit_and_plot_pytorch(3)5. 小结

1)正则化通过为模型损失函数添加惩罚项使学出的模型参数值较小,是应对过拟合的常用⼿段。

2)权衰减等价于L2范数正则化,通常会使学到的权重参数的元素较接近0(使得模型更简单)。

3)权衰减可以通过优化器中的weight_decay超参数来指定。

4)可以定义多个优化器实例对不同的模型参数使用不同的迭代方法。