flinkSQL数据写kafka多分区

1、背景

FlinkSQL数据写kafka,如果不设置并行度,默认是1。

但是由于数据量和下游消费者的需求,需要往多个kafka分区写数据,提高并发,在这个情况下,需要保证同一个主键的数据发往同一个partition,flinkSQL已经支持这个功能,接下来我们实现一下

2、实现(python代码)

只需要两步:

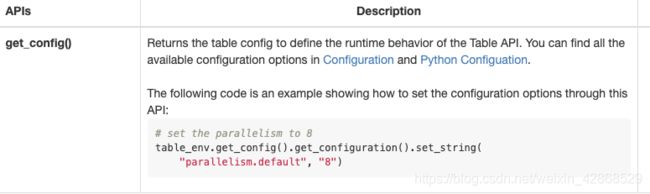

1⃣️初始化:初始化加上flink并行的配置table_env.get_config().get_configuration().set_string(“parallelism.default”, “3”)

2⃣️sink:在写sink的时候加上参数sink.partitioner

初始化

from pyflink.table import EnvironmentSettings, StreamTableEnvironment

import time

import sys

#timestamp_str=sys.argv[1]

#timestamp=int(time.mktime(time.strptime(timestamp_str,"%Y-%m-%d %H:%M:%S"))*1000)

env_settings = EnvironmentSettings.new_instance().in_streaming_mode().use_blink_planner().build()

table_env = StreamTableEnvironment.create(environment_settings=env_settings)

table_env.get_config().get_configuration().set_string("parallelism.default", "3")

往kafka多分区写数据,flink的分区可以是一个也可以是多个,一下是flink官网提供的设置并行的例子

sink

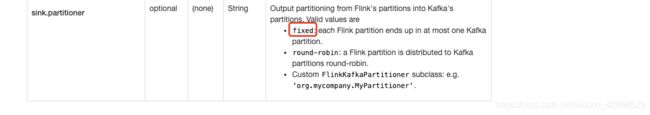

在sink的代码里加上参数’sink.partitioner’=‘fixed’

table_env.execute_sql("""create table res(

uid string,

mobile string,

courseId string,

viewingTime bigint,

updateTime bigint,

liveDuration string

)with(

'connector'='kafka',

'topic'='flink_par2',

'properties.bootstrap.servers' = 'localhost:9092',

'format' = 'changelog-json',

'sink.partitioner'='fixed'

)""")

官网给的解释:

fixed是每个flink partition的数据最多往一个kafka partition里写(我们使用这个参数)

round-robin是一个flink partition会往多个kafka partition里写

原理与注意事项

flink kafka sink 默认分区器 FlinkFixedPartitioner 原理与注意

package org.apache.flink.streaming.connectors.kafka.partitioner;

import org.apache.flink.util.Preconditions;

public class FlinkFixedPartitioner extends FlinkKafkaPartitioner {

private int parallelInstanceId;

public FlinkFixedPartitioner() {

}

public void open(int parallelInstanceId, int parallelInstances) {

Preconditions.checkArgument(parallelInstanceId >= 0, "Id of this subtask cannot be negative.");

Preconditions.checkArgument(parallelInstances > 0, "Number of subtasks must be larger than 0.");

this.parallelInstanceId = parallelInstanceId;

}

public int partition(T record, byte[] key, byte[] value, String targetTopic, int[] partitions) {

Preconditions.checkArgument(partitions != null && partitions.length > 0, "Partitions of the target topic is empty.");

return partitions[this.parallelInstanceId % partitions.length];

}

}

根据源码可以看出:

flink是根据sink的subtask的id和kafka的partition数量进行取余计算的,计算过程如下:

flink并行度为3(F0,F1,F2),partition数量为2(P0,P1),则F0->P0,F1->P1,F2->P0

flink并行度为2(F0,F1),partition数量为3(P0,P1,P2),则F0->P0,F1->P1

因此默认分区器会有2个坑:

当 Sink 的并发度低于 Topic 的 partition 个数时,一个 sink task 写一个 partition,会导致部分 partition 完全没有数据。

当 topic 的 partition 扩容时,则需要重启作业,以便发现新的 partition。

以上,

长的这么帅的你不会不给我点个赞就走了吧