- 阅读笔记:阅读方法中的逻辑和转念

施吉涛

聊聊一些阅读的方法论吧,别人家的读书方法刚开始想写,然后就不知道写什么了,因为作者写的非常的“精致”我有一种乡巴佬进城的感觉,看到精美的摆盘,精致的食材不知道该如何下口也就是《阅读的方法》,我们姑且来试一下强劲的大脑篇,第一节:逻辑通俗的来讲,也就是表达的排列和顺序,再进一步就是因果关系和关联实际上书已经看了大概一遍,但直到打算写一下笔记的时候,才发现作者讲的推理更多的是阅读的对象中呈现出的逻辑也

- 20220226号今日份(6)

张雅苑Momo

考虑以下必备行程安排:1作息规律2三餐规律3早茶下午茶4晨练运动5阅读笔记6挚爱亲朋联络20220226号今日份快乐是有哪一些呢?1:视频号直播的持续今天已经是第221/190天啦今天主讲人在分享事上练的能力,事上见2:持续吉他练习今天已经第25天啦3:今天持续带动某人整理屋子,要加油哦,要持续哦今天的过程持续比较轻松愉快4:今天老佛爷入院的第四天,上阵父子兵,期待他们仨早起凯旋归来如何成为自己喜

- 24营2组锋妈11月13日作业及阅读笔记

锋妈

第一部分,听课心得在《时间管理目标模型课程》中,主要学到了如下四点:一、为什么要制定目标二、怎么样制定目标三、制定目标后要做些什么四、立刻行动起来听完后,对照讲课提纲,是自身的存在的弱点,觉着最大的绊脚石是第四点立刻行动起来。因为再宏伟的目标,再强大的驱动力下,如果没有行动去执行,一切都是空谈。为了避免执行力弱化,结合自己目前实际情况,觉着尽量把目标制定的简单明了、可执行、可衡量、可反馈回顾的。只

- 他为了她努力发家致富,五年后她却要了他的命 ——《了不起的盖茨比》读后感

一切来得及

《大亨小传》?又一译名春节期间,我参加了网易蜗牛读书举行的“7天CP读”活动。活动规则是在小程序里配对,两人共读一本书。我选的书是《了不起的盖茨比》,早就闻名,早就想读,却一直没开始的一本书。老话说得没错,男女搭配,干活不累。想不到读书也是如此。不到六天,我就读完了全书,写了近30条阅读笔记。与此同时,与我搭档的美女好像忙着发财,一直没动头。不过,我还是感谢她,感谢她赐予我阅读的力量!读完全书,我

- A1/A2: S.O.S. Urgences, Chapitre 1

自观问渠

阅读笔记,Chapitre11.Allô!喂;公司接线员的用语:Allôbonjour,公司名。2.S.O.S.派遣医生上门服务3.请说!Jevousécoute./Jet'écoute.使用场景:我听你讲,你说吧。私人聊天,正式场合4.C'estpourqqn表示目的用pour5.Ilfaut用法Jepeuxvenir,maisilfautuneadresse.ilfaut+名词必须有某物Ilf

- 阅读笔记-有一种女人

张海佩happy

来自@寒山说,致谢!有一种女人,咋一看性格温柔,为人谦和有礼,易接触,可走近发现她自带“疏离感“。她的疏离感并非源自“傲”,而是因她内心太过丰富,且过于敏感。她觉得人类的悲喜并不相同,故而选择保持距离,她的同理心强,共情力更强,她深深地理解他人的痛苦,绝不轻易伤害他人。她礼貌处世,既不向上奉承,也不向下贬低,不以物喜,不以己悲,是温柔到骨子里的人。她拥有自己的精神世界,她可能会沉迷于小说里的某句台

- 论文阅读笔记(十九):YOLO9000: Better, Faster, Stronger

__Sunshine__

笔记YOLO9000detectionclassification

WeintroduceYOLO9000,astate-of-the-art,real-timeobjectdetectionsystemthatcandetectover9000objectcategories.FirstweproposevariousimprovementstotheYOLOdetectionmethod,bothnovelanddrawnfrompriorwork.Theim

- 论文阅读笔记: DINOv2: Learning Robust Visual Features without Supervision

小夏refresh

论文计算机视觉深度学习论文阅读笔记深度学习计算机视觉人工智能

DINOv2:LearningRobustVisualFeatureswithoutSupervision论文地址:https://arxiv.org/abs/2304.07193代码地址:https://github.com/facebookresearch/dinov2摘要大量数据上的预训练模型在NLP方面取得突破,为计算机视觉中的类似基础模型开辟了道路。这些模型可以通过生成通用视觉特征(即无

- 马克 米勒维尼《动量大师 超级交易员圆桌访谈录》阅读笔记59

小二菜园

问题59:你在分析中是否使用利润率或净资产收益率(ROE)?马克·米勒维尼:是的。我喜欢看到不断扩大的利润率。有时,这可能是一个公司业绩改善但销售为负背后的催化剂。但就像我说的,没有销售收入,你只能在一段时间内提高收益。净资产收益率是你应该用来比较你的股票与同一行业其他股票的东西,一般来说,更好的股票会有15-17%或更高的净资产收益率。大卫·瑞恩:它们都是值得关注的指标,也是我进一步研究公司盈利

- 《以色列——一个民族的重生》第四到第六章阅读笔记

惠尔好我

在奥斯曼帝国统治时期,阿拉伯人就意识到,巴勒斯坦生活的犹太人将改变该地区的“阿拉伯属性”。第一次犹太移民潮中,欧洲犹太人带来的观念和现代性和当地犹太人以及阿拉伯人的意识形态发生冲突。可以说,当地人和外来者对国家和社会抱有的不同理念、对荣誉和记忆的不同感受以及许多其他方面的难以沟通,成为后来犹太人和阿拉伯人长期冲突的重要原因。反观中华民族强大的包容性,同化性,共生性带来了强大的生命力。为了架起各方沟

- 《少有人走的路》第三部分信仰和世界观分阅读笔记

芦絮

爱的本质是拓展自我,必须进入未知的领域,放弃落后的,陈旧的自己,把陈腐过时的认知踩在脚下,抛弃狭隘的人生观。做到以上这些必须对过去提出疑问,怀疑和挑战,才能使我们走上神圣的自由之路!作者分别用三位患者举例说明,所有的一切习惯,宗教信仰基本都来源于父母,不幸的童年,所以一个人的心智与家人,朋友,环境是息息相关,我们要给自己输送正能量的东西,让自己充满正能量,做一个阳光的人!

- llama_index 官方文档阅读笔记 (持续更新版)

皮卡丘ZPC

AIGCforGPT评分体系构架笔记llama人工智能语言模型

llama0.10.17版本阅读链接:LlamaIndexv0.10.17LlamaIndex是一个基于LLM的应用程序的数据框架,它受益于上下文增强。这种LLM系统被称为RAG系统,代表“检索-增强生成”。LlamaIndex提供了必要的抽象,以便更轻松地摄取、构建和访问私有或特定于域的数据,以便将这些数据安全可靠地注入LLM,以实现更准确的文本生成。为什么选择上下文增强?LLM的局限LLM在人

- 我理解的《月亮和六便士》(3)

澎波先生

突然发现这样慢慢地阅读一本书,每天写所读部分的阅读笔记,挺有意思的。我个人觉得,这是个将书读厚的过程,虽然这个厚还只是对书本内容的解读,还没到联系实际的理解,但阅读本身就很有趣,也应该知足了。阅读笔记三:今天看到了48%,不得不说这部分其实有些狗血。这部分说到主人公、老戴和查理斯三人之间存在着某种奇怪的友情,直到查理斯病倒了,老戴说服他夫人勃朗仕让查理斯住在家里的画室,并且两人一起照顾查理斯。病后

- 《卓有成效的管理者》第一章阅读笔记与心得

张建平深圳

自我管理这是一个做管理多年的朋友推荐给我的第一本德鲁克的书。开始以为是一本专门企业管理的书,看完才知道是一本自我管理的书。图片发自App彼得.德鲁克,号称管理科学“大师中的大师”。是“工业时代”到“知识时代”管理学的桥梁搭建者。图片发自App推荐他著作的牛人很多,就知道他的思想有多重要。如果不好好读,不深入读,不读以致用,就等于跟风装13(跟00后学的装B新词),等于没读。图片发自App这本书适合

- 阅读笔记3《有钱人和你想的不一样》230305财富蓝图

Mika罗盘上的点

重新设定为收入稳定增长的模式。认知“实现程序”为这个形式:设定→想法→感觉→行动=结果设定会产生想法;想法产生感觉;感觉产生行动;行动产生结果。我要再强调一次:潜意识所受到的制约,决定了思想;思想决定了选择;选择决定了行动,而行动就决定了结果。第一个改变的步骤:修改语言程式一、察觉:写下小时候听过的所有描述金钱、财富和有钱人的话语。二、理解:写下认为这些说法如何影响财务生活。三、划清界限:有没有看

- 近乎无事的悲哀——《风筝》阅读笔记

天光云影好丹青

某一天,我们心底也会留有这样莫可名状的惆怅吗?———不算题记的题记对于从事现代文学教学与研究的人而言,如果硬要说有某一个作家是不可绕过的,那么,可以断定所有的人都会毫不犹豫地将神圣的一票投给“鲁迅”。不管你是否真正知晓中国的过去与现状,也不管你是否真的能够同鲁迅实现内在心灵上的共鸣,他之于这个国家的文学历史、之于这个国家本身的重要性,至少在今天都还是不言而喻的。刘再复1978年《略论鲁迅思想的发展

- 2-12 三观易碎d2阅读笔记

二桥啊

摘抄:回头看整个成长时期最遗憾的事,就是我们自己糊涂的时候,那些引导我们的前辈没能给我们以真正的启迪想法:看到这句话时,我心一凉,我后悔的事情有很多,可不曾真正考虑过这一点,长辈们对我的教育大体没错,可是有的东西我明白得太晚,譬如学习的意义、恋爱、婚姻、性观念等问题,他们给我提供他们认为好的物质,然后有些观念形成得晚也事实上令我错失一些东西,好在我现在也在学习也在慢慢去明白,现如今我也在长辈的路上

- Robotic TMS(三):机器人TMS相关技术

巴普蒂斯塔

机器人学TMS机器人系统轨迹规划运动控制视觉私服

本文为阅读笔记,仅供学习交流使用!!!从之前的文章中可以归纳出与机器人辅助经颅磁刺激相关的一些重要技术。包括:机械臂的(1)运动轨迹跟踪技术;(2)视觉私服控制;(3)视觉标定技术;(4)轨迹规划;(5)位置和力控制;(6)安全问题。一、运动轨迹跟踪为了避免固定受试者的头部,应使用跟踪系统来引导和调整线圈的位置和方向。有许多类似的跟踪系统可供选择:空间连杆机构、超声波跟踪系统、磁场跟踪系统、以及光

- Robotic TMS(一):TMS(经颅磁刺激)介绍

巴普蒂斯塔

机器人学TMSRobotic神经科学脑科学机器人学

本文为阅读笔记,仅供学习交流使用!!!经颅磁刺激技术(TranscranialMagneticStimulation,TMS)是一种无痛、无创的绿色治疗方法,磁信号可以无衰减地透过颅骨而刺激到大脑神经。随着技术的发展,具有连续可调重复刺激的经颅磁刺激(rTMS)出现,并在临床精神病、神经疾病及康复领域获得越来越多的认可。经颅磁刺激技术得到了广泛的使用,国内的经颅磁刺激技术达到世界先进水平,在神经心

- SAFEFL: MPC-friendly Framework for Private and Robust Federated Learning论文阅读笔记

慘綠青年627

论文阅读笔记深度学习

SAFEFL:MPC-friendlyFrameworkforPrivateandRobustFederatedLearning适用于私有和鲁棒联邦学习的MPC友好框架SAFEFL,这是一个利用安全多方计算(MPC)来评估联邦学习(FL)技术在防止隐私推断和中毒攻击方面的有效性和性能的框架。概述传统机器学习(ML):集中收集数据->隐私保护问题privacy-preservingML(PPML)采

- 目标思维、效率思维、行动力思维

蓝色多莉

阅读笔记第163/365天今日阅读《从怕学习到爱学习》——一本给父母的优等生养成指南作者:张萌第三章:高效行动力。一、目标思维。——孩子做事没耐心,不能持之以恒怎么办?1、做任何事都需要一个理由。孩子做事没有耐心,不能持久的原因:一是,缺乏兴趣。二是,缺少自制力。做事时注意力分散,不会分配精力。家长要帮助孩子找回性耐心,找回兴趣,提起做事的劲儿,需要让孩子拥有目标思维,利用目标思维帮助孩子找到自己

- 《登天的感觉》阅读笔记 案例解析(2)

dear心理咨询师黄倩雯

来询者之所以会对咨询者产生特殊的好感,主要是因为后者在前者头脑混乱,情绪低落之际,给予了对方由衷的理解和支持。

- Circle Loss: A Unified Perspective of Pair Similarity Optimization简要阅读笔记

dailleson_

机器学习机器学习数据挖掘神经网络深度学习自然语言处理

1.背景常见的分类损失函数可以概括为减小类内距离sns_nsn,增大类间距离sps_psp。优化目标如下:min(sn−sp)min(s_n-s_p)min(sn−sp)2.存在的问题优化不够灵活。优化目标对sns_nsn和sps_psp的惩罚作用是相等的,二者的系数都为1。例如{sn,sp}={0.1,0.5}\{s_n,s_p\}=\{0.1,0.5\}{sn,sp}={0.1,0.5}。这个

- 一对母女的深度阅读笔记:给孩子最强大脑不如陪孩子读遍好书

朝南有飘窗

我们分享过不少“深度阅读”的方法,其中很重要的一点,是在阅读后,制作一份“研究报告”,比如设计精致的阅读海报(点此阅读),今天再分享一个妈妈带女儿用思维导图,围绕虚构类和非虚构类好书制作的读书笔记,不仅授予孩子检索、总结等技能,更塑造孩子不断求知的好习惯。虚构类图书:探究故事的背景提出问题,是引发思考的第一步。当孩子着迷于一个故事的时候,家长可以找到那个有趣的问题,引导孩子体会思考的乐趣。国外的孩

- Nginx源码阅读笔记-内存池的设计

weixin_33701564

运维python数据结构与算法

2019独角兽企业重金招聘Python工程师标准>>>nginx的内存池设计的比较简单了,一个内存池中分为两个部分:超过max大小的内存分配,走大块内存分配,这部分内存管理由ngx_pool_large_t结构体负责。否则就是在ngx_pool_t遍历符合要求的ngx_pool_t结构体,找到符合要求大小的pool直接返回,否则就申请一块新的内存pool。nginx中所有请求都单独对应一个内存池,

- 核心2群3组耿艳菊2018.7.17阅读笔记

耿艳菊

《少有人走的路》我们大多人趋向于逃避一切痛苦和折磨,对某些消极现象可能熟视无睹,对残酷的现实可能不闻不问,我们捍卫自己的意识,不让真实的信息侵入其中,心理学家把这种情形成为“意识的防卫机制”。每个人都可能采用这种机制,有意限制自己的认知范围和认知能力。我们生活在现实世界里,要想生活得更好,必须尽可能地了解世界的本质,但了解的过程无法一蹴而就。要洞悉世界的本质,认清自己和世界的关系,我们就可能经受各

- A Tutorial on Near-Field XL-MIMO Communications Towards 6G【论文阅读笔记】

Cc小跟班

【论文阅读】相关论文阅读笔记

此系列是本人阅读论文过程中的简单笔记,比较随意且具有严重的偏向性(偏向自己研究方向和感兴趣的),随缘分享,共同进步~论文主要内容:建立XL-MIMO模型,考虑NUSW信道和非平稳性;基于近场信道模型,分析性能(SNRscalinglaws,波束聚焦、速率、DoF)XL-MIMO设计问题:信道估计、波束码本、波束训练、DAMXL-MIMO信道特性变化:UPW➡NUSW空间平稳–>空间非平稳(可视区域

- 阅读笔记

李蓉乐平市湾头中小学

今日份阅读《成年人的世界没有容易二字》。这种鸡汤文,对人的发展真的没太大意义,通篇教你要如何努力,却教不了你真正的自律,每一条文字都能让你对号入座,却不能让你真正发生改变,不是说它不好,于本书而言是真正的鸡汤,但它能带给你智慧是有限的,一本好书,通常不会过多的去反映社会现实,和取悦读者,而是能够触及到生命意义让你有所反思的书。所以把这段话读给我班学生听,我只是一只蚂蚁撼不动大树,如若能撼动一片树叶

- 14.犹太人的智慧法则 | #阅读笔记#01-《财源滚滚:犹太人赚钱的十诫》

拉布拉多滚雪球

这是拉布拉多滚雪球的第14篇原创投资者,特别是投资小白如大学生和初入职场者,受限于思维认知和人生经历匮乏等原因,在贸然进入资本市场后,往往损失惨重,并且不明白究竟为何亏损,进而反复遭到“市场先生”教育,最终只能铩羽而归,失去万般艰险得来的一点本金。本号在前期大多分享的是财经类著作,专注于资本市场历史案例和真实活动,需要读者具备一定的专业理论基础,对于缺乏财经知识积累的人全面系统地理解相关理念存在门

- 时序预测相关论文阅读笔记

能力越小责任越小YA

论文阅读笔记时序预测Transformer

笔记链接:【有道云笔记】读论文(记录)https://note.youdao.com/s/52ugLbot用于个人学习记录。

- ztree设置禁用节点

3213213333332132

JavaScriptztreejsonsetDisabledNodeAjax

ztree设置禁用节点的时候注意,当使用ajax后台请求数据,必须要设置为同步获取数据,否者会获取不到节点对象,导致设置禁用没有效果。

$(function(){

showTree();

setDisabledNode();

});

- JVM patch by Taobao

bookjovi

javaHotSpot

在网上无意中看到淘宝提交的hotspot patch,共四个,有意思,记录一下。

7050685:jsdbproc64.sh has a typo in the package name

7058036:FieldsAllocationStyle=2 does not work in 32-bit VM

7060619:C1 should respect inline and

- 将session存储到数据库中

dcj3sjt126com

sqlPHPsession

CREATE TABLE sessions (

id CHAR(32) NOT NULL,

data TEXT,

last_accessed TIMESTAMP NOT NULL,

PRIMARY KEY (id)

);

<?php

/**

* Created by PhpStorm.

* User: michaeldu

* Date

- Vector

171815164

vector

public Vector<CartProduct> delCart(Vector<CartProduct> cart, String id) {

for (int i = 0; i < cart.size(); i++) {

if (cart.get(i).getId().equals(id)) {

cart.remove(i);

- 各连接池配置参数比较

g21121

连接池

排版真心费劲,大家凑合看下吧,见谅~

Druid

DBCP

C3P0

Proxool

数据库用户名称 Username Username User

数据库密码 Password Password Password

驱动名

- [简单]mybatis insert语句添加动态字段

53873039oycg

mybatis

mysql数据库,id自增,配置如下:

<insert id="saveTestTb" useGeneratedKeys="true" keyProperty="id"

parameterType=&

- struts2拦截器配置

云端月影

struts2拦截器

struts2拦截器interceptor的三种配置方法

方法1. 普通配置法

<struts>

<package name="struts2" extends="struts-default">

&

- IE中页面不居中,火狐谷歌等正常

aijuans

IE中页面不居中

问题是首页在火狐、谷歌、所有IE中正常显示,列表页的页面在火狐谷歌中正常,在IE6、7、8中都不中,觉得可能那个地方设置的让IE系列都不认识,仔细查看后发现,列表页中没写HTML模板部分没有添加DTD定义,就是<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3

- String,int,Integer,char 几个类型常见转换

antonyup_2006

htmlsql.net

如何将字串 String 转换成整数 int?

int i = Integer.valueOf(my_str).intValue();

int i=Integer.parseInt(str);

如何将字串 String 转换成Integer ?

Integer integer=Integer.valueOf(str);

如何将整数 int 转换成字串 String ?

1.

- PL/SQL的游标类型

百合不是茶

显示游标(静态游标)隐式游标游标的更新和删除%rowtyperef游标(动态游标)

游标是oracle中的一个结果集,用于存放查询的结果;

PL/SQL中游标的声明;

1,声明游标

2,打开游标(默认是关闭的);

3,提取数据

4,关闭游标

注意的要点:游标必须声明在declare中,使用open打开游标,fetch取游标中的数据,close关闭游标

隐式游标:主要是对DML数据的操作隐

- JUnit4中@AfterClass @BeforeClass @after @before的区别对比

bijian1013

JUnit4单元测试

一.基础知识

JUnit4使用Java5中的注解(annotation),以下是JUnit4常用的几个annotation: @Before:初始化方法 对于每一个测试方法都要执行一次(注意与BeforeClass区别,后者是对于所有方法执行一次)@After:释放资源 对于每一个测试方法都要执行一次(注意与AfterClass区别,后者是对于所有方法执行一次

- 精通Oracle10编程SQL(12)开发包

bijian1013

oracle数据库plsql

/*

*开发包

*包用于逻辑组合相关的PL/SQL类型(例如TABLE类型和RECORD类型)、PL/SQL项(例如游标和游标变量)和PL/SQL子程序(例如过程和函数)

*/

--包用于逻辑组合相关的PL/SQL类型、项和子程序,它由包规范和包体两部分组成

--建立包规范:包规范实际是包与应用程序之间的接口,它用于定义包的公用组件,包括常量、变量、游标、过程和函数等

--在包规

- 【EhCache二】ehcache.xml配置详解

bit1129

ehcache.xml

在ehcache官网上找了多次,终于找到ehcache.xml配置元素和属性的含义说明文档了,这个文档包含在ehcache.xml的注释中!

ehcache.xml : http://ehcache.org/ehcache.xml

ehcache.xsd : http://ehcache.org/ehcache.xsd

ehcache配置文件的根元素是ehcahe

ehcac

- java.lang.ClassNotFoundException: org.springframework.web.context.ContextLoaderL

白糖_

javaeclipsespringtomcatWeb

今天学习spring+cxf的时候遇到一个问题:在web.xml中配置了spring的上下文监听器:

<listener>

<listener-class>org.springframework.web.context.ContextLoaderListener</listener-class>

</listener>

随后启动

- angular.element

boyitech

AngularJSAngularJS APIangular.element

angular.element

描述: 包裹着一部分DOM element或者是HTML字符串,把它作为一个jQuery元素来处理。(类似于jQuery的选择器啦) 如果jQuery被引入了,则angular.element就可以看作是jQuery选择器,选择的对象可以使用jQuery的函数;如果jQuery不可用,angular.e

- java-给定两个已排序序列,找出共同的元素。

bylijinnan

java

import java.util.ArrayList;

import java.util.Arrays;

import java.util.List;

public class CommonItemInTwoSortedArray {

/**

* 题目:给定两个已排序序列,找出共同的元素。

* 1.定义两个指针分别指向序列的开始。

* 如果指向的两个元素

- sftp 异常,有遇到的吗?求解

Chen.H

javajcraftauthjschjschexception

com.jcraft.jsch.JSchException: Auth cancel

at com.jcraft.jsch.Session.connect(Session.java:460)

at com.jcraft.jsch.Session.connect(Session.java:154)

at cn.vivame.util.ftp.SftpServerAccess.connec

- [生物智能与人工智能]神经元中的电化学结构代表什么?

comsci

人工智能

我这里做一个大胆的猜想,生物神经网络中的神经元中包含着一些化学和类似电路的结构,这些结构通常用来扮演类似我们在拓扑分析系统中的节点嵌入方程一样,使得我们的神经网络产生智能判断的能力,而这些嵌入到节点中的方程同时也扮演着"经验"的角色....

我们可以尝试一下...在某些神经

- 通过LAC和CID获取经纬度信息

dai_lm

laccid

方法1:

用浏览器打开http://www.minigps.net/cellsearch.html,然后输入lac和cid信息(mcc和mnc可以填0),如果数据正确就可以获得相应的经纬度

方法2:

发送HTTP请求到http://www.open-electronics.org/celltrack/cell.php?hex=0&lac=<lac>&cid=&

- JAVA的困难分析

datamachine

java

前段时间转了一篇SQL的文章(http://datamachine.iteye.com/blog/1971896),文章不复杂,但思想深刻,就顺便思考了一下java的不足,当砖头丢出来,希望引点和田玉。

-----------------------------------------------------------------------------------------

- 小学5年级英语单词背诵第二课

dcj3sjt126com

englishword

money 钱

paper 纸

speak 讲,说

tell 告诉

remember 记得,想起

knock 敲,击,打

question 问题

number 数字,号码

learn 学会,学习

street 街道

carry 搬运,携带

send 发送,邮寄,发射

must 必须

light 灯,光线,轻的

front

- linux下面没有tree命令

dcj3sjt126com

linux

centos p安装

yum -y install tree

mac os安装

brew install tree

首先来看tree的用法

tree 中文解释:tree

功能说明:以树状图列出目录的内容。

语 法:tree [-aACdDfFgilnNpqstux][-I <范本样式>][-P <范本样式

- Map迭代方式,Map迭代,Map循环

蕃薯耀

Map循环Map迭代Map迭代方式

Map迭代方式,Map迭代,Map循环

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 2015年

- Spring Cache注解+Redis

hanqunfeng

spring

Spring3.1 Cache注解

依赖jar包:

<!-- redis -->

<dependency>

<groupId>org.springframework.data</groupId>

<artifactId>spring-data-redis</artifactId>

- Guava中针对集合的 filter和过滤功能

jackyrong

filter

在guava库中,自带了过滤器(filter)的功能,可以用来对collection 进行过滤,先看例子:

@Test

public void whenFilterWithIterables_thenFiltered() {

List<String> names = Lists.newArrayList("John"

- 学习编程那点事

lampcy

编程androidPHPhtml5

一年前的夏天,我还在纠结要不要改行,要不要去学php?能学到真本事吗?改行能成功吗?太多的问题,我终于不顾一切,下定决心,辞去了工作,来到传说中的帝都。老师给的乘车方式还算有效,很顺利的就到了学校,赶巧了,正好学校搬到了新校区。先安顿了下来,过了个轻松的周末,第一次到帝都,逛逛吧!

接下来的周一,是我噩梦的开始,学习内容对我这个零基础的人来说,除了勉强完成老师布置的作业外,我已经没有时间和精力去

- 架构师之流处理---------bytebuffer的mark,limit和flip

nannan408

ByteBuffer

1.前言。

如题,limit其实就是可以读取的字节长度的意思,flip是清空的意思,mark是标记的意思 。

2.例子.

例子代码:

String str = "helloWorld";

ByteBuffer buff = ByteBuffer.wrap(str.getBytes());

Sy

- org.apache.el.parser.ParseException: Encountered " ":" ": "" at line 1, column 1

Everyday都不同

$转义el表达式

最近在做Highcharts的过程中,在写js时,出现了以下异常:

严重: Servlet.service() for servlet jsp threw exception

org.apache.el.parser.ParseException: Encountered " ":" ": "" at line 1,

- 用Java实现发送邮件到163

tntxia

java实现

/*

在java版经常看到有人问如何用javamail发送邮件?如何接收邮件?如何访问多个文件夹等。问题零散,而历史的回复早已经淹没在问题的海洋之中。

本人之前所做过一个java项目,其中包含有WebMail功能,当初为用java实现而对javamail摸索了一段时间,总算有点收获。看到论坛中的经常有此方面的问题,因此把我的一些经验帖出来,希望对大家有些帮助。

此篇仅介绍用

- 探索实体类存在的真正意义

java小叶檀

POJO

一. 实体类简述

实体类其实就是俗称的POJO,这种类一般不实现特殊框架下的接口,在程序中仅作为数据容器用来持久化存储数据用的

POJO(Plain Old Java Objects)简单的Java对象

它的一般格式就是

public class A{

private String id;

public Str

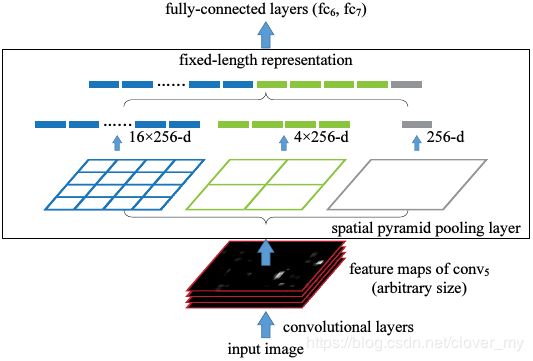

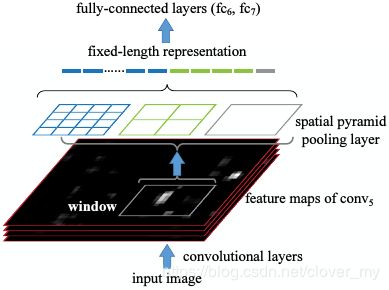

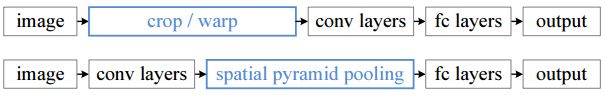

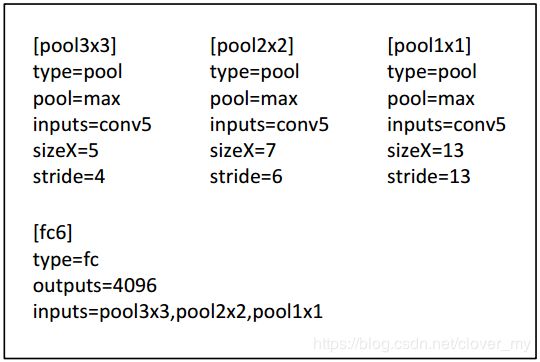

![]() ,步长为

,步长为![]() 。下图以conv5输出的大小为13*13为例:

。下图以conv5输出的大小为13*13为例: