数学基础——线性代数(一)

一、线性系统

一个线性系统满足两个条件:叠加性和齐次性。

假设有两个输入 x 1 ( t ) , x 2 ( t ) x_1(t),x_2(t) x1(t),x2(t)及其对应的输出 y 1 ( t ) = H { x 1 ( t ) } , y 2 ( t ) = H { x 1 ( t ) } y_1(t)=H\{x_1(t)\},y_2(t)=H\{x_1(t)\} y1(t)=H{x1(t)},y2(t)=H{x1(t)},其中H代表线性系统,那么可以得到 α y 1 ( t ) + β y 2 ( t ) = H { α x 1 ( t ) + β x 2 ( t ) } \alpha y_1(t)+ \beta y_2(t)=H\{\alpha x_1(t) + \beta x_2(t)\} αy1(t)+βy2(t)=H{αx1(t)+βx2(t)}

二、向量和矩阵

1、向量(Vectors)

向量是一堆数的集合,分为行向量和列向量,这里说向量默认为列向量。

向量与标量相乘: 每个维度都跟该标量相乘。

X = [ x 1 x 2 ] , c X = [ c x 1 c x 2 ] {X=\begin{bmatrix}x_1 \\x_2 \end{bmatrix}},{cX=\begin{bmatrix}cx_1 \\cx_2 \end{bmatrix}} X=[x1x2],cX=[cx1cx2]

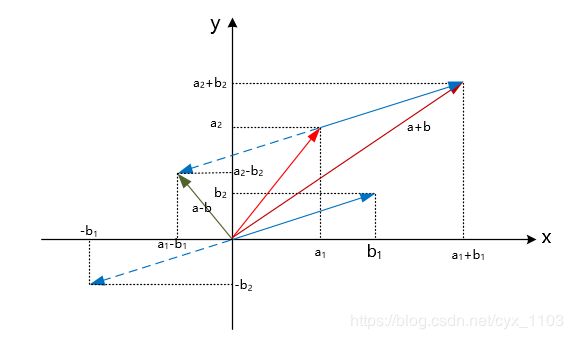

向量加减: 使用平行四边形法则。

a ± b = [ a 1 a 2 ] ± [ b 1 b 2 ] = [ a 1 ± b 1 a 2 ± b 2 ] {a\pm b=\begin{bmatrix}a_1 \\a_2 \end{bmatrix}\pm \begin{bmatrix}b_1 \\b_2 \end{bmatrix}= \begin{bmatrix}a_1\pm b_1 \\a_2\pm b_2 \end{bmatrix}} a±b=[a1a2]±[b1b2]=[a1±b1a2±b2]

向量集: 可以包含有限或者无限个向量。

χ = { [ x 1 x 2 ] : x 1 + x 2 = 0 } {\chi =\{\begin{bmatrix}x_1 \\x_2 \end{bmatrix}: x_1+x_2=0\}} χ={[x1x2]:x1+x2=0}

标准向量: 只有一个维度为1其他维度为0的向量。

R n {R_n} Rn: 由所有的n维向量组成的集合。

(1)向量操作

a.线性相关和线性无关:

- 已知一组向量 { v 1 , v 2 , … , v n } {\lbrace{v_1,v_2,\ldots,v_n\rbrace}} {v1,v2,…,vn},若存在一组不全为0的实数 a 1 , a 2 , … , a n {a_1,a_2,\ldots,a_n} a1,a2,…,an,使得 ∑ i = 1 n a i v i = 0 \sum_{i=1}^n {a_iv_i}=0 ∑i=1naivi=0,则这组向量 { v 1 , v 2 , … , v n } {\lbrace{v_1,v_2,\ldots,v_n\rbrace}} {v1,v2,…,vn}是线性相关的。

- 已知一组向量 { v 1 , v 2 , … , v n } {\lbrace{v_1,v_2,\ldots,v_n\rbrace}} {v1,v2,…,vn},若当且仅当 a i = 0 , i = 1 , 2 , … , n {a_i=0,i=1,2,\ldots,n} ai=0,i=1,2,…,n时才有 ∑ i = 1 n a i v i = 0 \sum_{i=1}^n {a_iv_i}=0 ∑i=1naivi=0,则这组向量 { v 1 , v 2 , … , v n } {\lbrace{v_1,v_2,\ldots,v_n\rbrace}} {v1,v2,…,vn}是线性无关的。

- 一个向量空间包含的最大线性无关向量的数目,称为该向量空间的维数。

b.向量的积:

- 二维向量的点积: u ⋅ v = u x v x + u y v y = ∣ u ∣ ∣ v ∣ cos ( u , v ) {u\cdot v=u_xv_x+u_yv_y=|u||v|\cos \left (u,v\right )} u⋅v=uxvx+uyvy=∣u∣∣v∣cos(u,v)

- 三维向量的点积: u ⋅ v = u x v x + u y v y + u z v z = ∣ u ∣ ∣ v ∣ cos ( u , v ) {u\cdot v=u_xv_x+u_yv_y+u_zv_z=|u||v|\cos \left (u,v\right )} u⋅v=uxvx+uyvy+uzvz=∣u∣∣v∣cos(u,v)

- 三维向量的叉积:其中i,j,k分别为x、y、z轴对应的单位向量 w = u × v = [ i j k u x u y u z v x v y v z ] {w=u\times v=\begin {bmatrix}i&j&k\\u_x&u_y&u_z\\v_x&v_y&v_z \end{bmatrix}} w=u×v=⎣⎡iuxvxjuyvykuzvz⎦⎤

- 叉积的性质

- u × v {u\times v} u×v垂直于 u 、 v {u、v} u、v所构成的平面,其方向符合右手规则。

- 叉积的模等于 u 、 v {u、v} u、v构成的平行四边形的面积。

- u × v = − v × u {u\times v=-v\times u} u×v=−v×u

- u × ( v × w ) = ( u ⋅ w ) v − ( u ⋅ v ) w {u\times (v\times w)=(u\cdot w)v-(u\cdot v)w} u×(v×w)=(u⋅w)v−(u⋅v)w

- 三维向量的混合积: [ u v w ] = ( u × v ) ⋅ w = u ⋅ ( v × w ) {\left[uvw\right]=(u\times v)\cdot w=u\cdot (v\times w)} [uvw]=(u×v)⋅w=u⋅(v×w)

- 物理意义:以 u 、 v 、 w {u、v、w} u、v、w为三个棱边所围成的平行六面体的体积,当 u 、 v 、 w {u、v、w} u、v、w构成右手关系时,该平行六面体的体积为正号。

- 两个向量的并矢:给定两个向量 X = ( x 1 , x 2 , … , x n ) T , Y = ( y 1 , y 2 , … , y m ) T {X=(x_1,x_2,\ldots,x_n)^T,Y=(y_1,y_2,\ldots,y_m)^T} X=(x1,x2,…,xn)T,Y=(y1,y2,…,ym)T,则两个向量的并矢记为: X Y T = ( x 1 y 1 x 1 y 2 … x 1 y m x 2 y 1 x 2 y 2 … x 2 y m ⋮ ⋮ ⋱ ⋮ x n y 1 x n y 2 … x n y m ) {\mathbf{XY^T} = \left( \begin{array}{ccc} x_{1}y_1 & x_{1}y_2 & \ldots & x_{1}y_m\\\\ x_{2}y_1 & x_{2}y_2 & \ldots & x_{2}y_m\\\\ \vdots & \vdots & \ddots & \vdots\\\\ x_{n}y_1 & x_{n}y_2& \ldots & x_{n}y_m \end{array} \right)} XYT=⎝⎜⎜⎜⎜⎜⎜⎜⎜⎜⎛x1y1x2y1⋮xny1x1y2x2y2⋮xny2……⋱…x1ymx2ym⋮xnym⎠⎟⎟⎟⎟⎟⎟⎟⎟⎟⎞也记作 X ⨂ Y {X\bigotimes Y} X⨂Y

2、矩阵(Matrix)

矩阵:由 m × n {m\times n} m×n个数组成的m行n列的数矩形阵表,当 m = n {m=n} m=n时称为方阵。

X = ( x 11 x 12 … x 1 n x 21 x 22 … x 2 n ⋮ ⋮ ⋱ ⋮ x m 1 x m 2 … x m n ) \mathbf{X} = \left( \begin{array}{ccc} x_{11} & x_{12} & \ldots & x_{1n}\\\\ x_{21} & x_{22} & \ldots & x_{2n}\\\\ \vdots & \vdots & \ddots & \vdots\\\\ x_{m1} & x_{m2}& \ldots & x_{mn} \end{array} \right) X=⎝⎜⎜⎜⎜⎜⎜⎜⎜⎜⎛x11x21⋮xm1x12x22⋮xm2……⋱…x1nx2n⋮xmn⎠⎟⎟⎟⎟⎟⎟⎟⎟⎟⎞

矩阵和标量相乘: 每个元素都和该标量相乘。

矩阵加减法: 两个矩阵必须形状相同才能进行加减法,对应位置元素相加减。

(1)同形状的矩阵运算的部分性质

假设A、B、C都是 m × n {m\times n} m×n的矩阵,s和t分别为两个标量。

{ A + B = B + A ( A + B ) + C = A + ( B + C ) ( s t ) A = s ( t A ) s ( A + B ) = s A + s B ( s + t ) A = s A + t A \begin{cases}A+B=B+A \\ (A+B)+C=A+(B+C) \\ (st)A=s(tA) \\ s(A+B)=sA+sB \\ (s+t)A=sA+tA \end{cases} ⎩⎪⎪⎪⎪⎪⎪⎨⎪⎪⎪⎪⎪⎪⎧A+B=B+A(A+B)+C=A+(B+C)(st)A=s(tA)s(A+B)=sA+sB(s+t)A=sA+tA

(2)特殊矩阵

a.对角矩阵:

除主对角线外其余元素均为0的矩阵。

X = ( λ 1 0 … 0 0 λ 2 … 0 ⋮ ⋮ ⋱ ⋮ 0 0 … λ n ) \mathbf{X} = \left( \begin{array}{ccc} \lambda _1 & 0 & \ldots & 0\\\\ 0 & \lambda _2 & \ldots & 0\\\\ \vdots & \vdots & \ddots & \vdots\\\\ 0 & 0& \ldots & \lambda _n \end{array} \right) X=⎝⎜⎜⎜⎜⎜⎜⎜⎜⎜⎛λ10⋮00λ2⋮0……⋱…00⋮λn⎠⎟⎟⎟⎟⎟⎟⎟⎟⎟⎞

b.单位矩阵:

对角矩阵的特殊情况,对角线元素的值均为1且是方阵,通常用 I n {I_n} In来表示 n × n {n\times n} n×n的单位矩阵。

I n = ( 1 0 … 0 0 1 … 0 ⋮ ⋮ ⋱ ⋮ 0 0 … 1 ) \mathbf{I_n} = \left( \begin{array}{ccc} 1 & 0 & \ldots & 0\\\\ 0 & 1 & \ldots & 0\\\\ \vdots & \vdots & \ddots & \vdots\\\\ 0 & 0& \ldots & 1 \end{array} \right) In=⎝⎜⎜⎜⎜⎜⎜⎜⎜⎜⎛10⋮001⋮0……⋱…00⋮1⎠⎟⎟⎟⎟⎟⎟⎟⎟⎟⎞

c.矩阵的转置:

沿主对角线为轴进行翻转,将原来矩阵的行值和列值互换得到的矩阵,转置的矩阵用 A T {A^T} AT表示。

A = [ x 11 x 12 x 13 x 21 x 22 x 23 ] , A T = [ x 11 x 21 x 12 x 22 x 13 x 23 ] {A=\begin{bmatrix}x_{11} & x_{12} & x_{13}\\x_{21} & x_{22} & x_{23}\end{bmatrix}},{A^T=\begin{bmatrix}x_{11} & x_{21}\\x_{12} & x_{22} \\x_{13} & x_{23}\end{bmatrix}} A=[x11x21x12x22x13x23],AT=⎣⎡x11x12x13x21x22x23⎦⎤

(3)矩阵转置的性质

{ ( A T ) T = A ( A + B ) T = A T + B T ( λ A ) T = λ A T ( A B ) T = B T A T \begin{cases}(A^T)^T=A \\ (A+B)^T=A^T+B^T \\ (\lambda A)^T=\lambda A^T \\ (AB)^T=B^TA^T \end{cases} ⎩⎪⎪⎪⎨⎪⎪⎪⎧(AT)T=A(A+B)T=AT+BT(λA)T=λAT(AB)T=BTAT

3、矩阵与向量相乘

已知矩阵A和向量X如下:

A = ( a 11 a 12 … a 1 n a 21 a 22 … a 2 n ⋮ ⋮ ⋱ ⋮ a m 1 a m 2 … a m n ) , X = [ x 1 x 2 ⋮ x n ] \mathbf{A} = \left( \begin{array}{ccc} a_{11} & a_{12} & \ldots & a_{1n}\\\\ a_{21} & a_{22} & \ldots & a_{2n}\\\\ \vdots & \vdots & \ddots & \vdots\\\\ a_{m1} & a_{m2}& \ldots & a_{mn} \end{array} \right),X=\begin{bmatrix}x_1 \\x_2 \\ \vdots \\x_n \end{bmatrix} A=⎝⎜⎜⎜⎜⎜⎜⎜⎜⎜⎛a11a21⋮am1a12a22⋮am2……⋱…a1na2n⋮amn⎠⎟⎟⎟⎟⎟⎟⎟⎟⎟⎞,X=⎣⎢⎢⎢⎡x1x2⋮xn⎦⎥⎥⎥⎤

可以得到矩阵A乘向量X的结果:

A X = [ a 11 x 1 + a 12 x 2 + … + a 1 n x n a 21 x 1 + a 22 x 2 + … + a 2 n x n ⋮ a m 1 x 1 + a m 2 x 2 + … + a m n x n ] = x 1 [ a 11 a 21 ⋮ a m 1 ] + x 2 [ a 12 a 22 ⋮ a m 2 ] + … + x n [ a 1 n a 2 n ⋮ a m n ] \mathbf{AX} = \left[ \begin{array}{ccc} a_{11}x_1+ a_{12}x_2 + \ldots+ a_{1n}x_n\\\\ a_{21}x_1+a_{22}x_2 +\ldots +a_{2n}x_n\\\\ \vdots \\\\ a_{m1}x_1 +a_{m2}x_2+\ldots + a_{mn}x_n \end{array} \right]=x_1\begin{bmatrix}a_{11} \\a_{21} \\ \vdots \\a_{m1} \end{bmatrix}+x_2\begin{bmatrix}a_{12} \\a_{22} \\ \vdots \\a_{m2} \end{bmatrix}+\ldots +x_n\begin{bmatrix}a_{1n} \\a_{2n} \\ \vdots \\a_{mn} \end{bmatrix} AX=⎣⎢⎢⎢⎢⎢⎢⎢⎢⎢⎡a11x1+a12x2+…+a1nxna21x1+a22x2+…+a2nxn⋮am1x1+am2x2+…+amnxn⎦⎥⎥⎥⎥⎥⎥⎥⎥⎥⎤=x1⎣⎢⎢⎢⎡a11a21⋮am1⎦⎥⎥⎥⎤+x2⎣⎢⎢⎢⎡a12a22⋮am2⎦⎥⎥⎥⎤+…+xn⎣⎢⎢⎢⎡a1na2n⋮amn⎦⎥⎥⎥⎤

从行的角度来看矩阵和向量相乘: 从行的角度看,矩阵A和向量X相乘,其结果是矩阵的A的每一行与向量x做点积的结果。

从列的角度来看矩阵和向量相乘: 从列的角度看,矩阵A和向量X相乘,其结果是将矩阵的每一列进行线性组合。

矩阵和向量相乘的部分性质

假设A、B都是 m × n {m\times n} m×n的矩阵, u 、 v ∈ R n {u、v\in R_n} u、v∈Rn,c为标量。

{ A ( u + v ) = A u + A v ( A + B ) u = A u + B u A ( c u ) = c ( A u ) = ( c A ) u I n v = v \begin{cases}A(u+v)=Au+Av \\ (A+B)u=Au+Bu \\ A(cu)=c(Au) =(cA)u\\ I_nv=v \end{cases} ⎩⎪⎪⎪⎨⎪⎪⎪⎧A(u+v)=Au+Av(A+B)u=Au+BuA(cu)=c(Au)=(cA)uInv=v