(8)Hive的DDL数据定义(表的操作)

文章目录

- 创建表

- 管理表

- 外部表

- 管理表和外部表的使用场景

- 案例实操

- 管理表与外部表的互相转换

- 分区表

- 分区表基本操作

- 创建分区表

- 加载数据到分区表中

- 单分区查询

- 增加分区

- 删除分区

- 查看分区

- 分区表注意事项

- 1.创建二级分区表

- 2.正常的加载数据

- 3.把数据直接上传到分区目录上,让分区表和数据产生关联的三种方式

- 修改表

- 增加/修改/替换列信息

- 删除表

创建表

1.建表语法

CREATE [EXTERNAL] TABLE [IF NOT EXISTS] table_name

[(col_name data_type [COMMENT col_comment], …)]

[COMMENT table_comment]

[PARTITIONED BY (col_name data_type [COMMENT col_comment], …)]

[CLUSTERED BY (col_name, col_name, …)

[SORTED BY (col_name [ASC|DESC], …)] INTO num_buckets BUCKETS]

[ROW FORMAT row_format]

[STORED AS file_format]

[LOCATION hdfs_path]

[TBLPROPERTIES (property_name=property_value, …)]

[AS select_statement]

2.字段解释说明

(1)CREATE TABLE 创建一个指定名字的表。如果相同名字的表已经存在,则抛出异常;用户可以用 IF NOT EXISTS 选项来忽略这个异常。

(2)EXTERNAL关键字可以让用户创建一个外部表,在建表的同时可以指定一个指向实际数据的路径(LOCATION),在删除表的时候,内部表的元数据和数据会被一起删除,而外部表只删除元数据,不删除数据。

(3)COMMENT:为表和列添加注释。

(4)PARTITIONED BY创建分区表

(5)CLUSTERED BY创建分桶表

(6)SORTED BY不常用,对桶中的一个或多个列另外排序

(7)ROW FORMAT

DELIMITED [FIELDS TERMINATED BY char] [COLLECTION ITEMS TERMINATED BY char]

[MAP KEYS TERMINATED BY char] [LINES TERMINATED BY char]

| SERDE serde_name [WITH SERDEPROPERTIES (property_name=property_value, property_name=property_value, …)]

用户在建表的时候可以自定义SerDe或者使用自带的SerDe。如果没有指定ROW FORMAT 或者ROW FORMAT DELIMITED,将会使用自带的SerDe。在建表的时候,用户还需要为表指定列,用户在指定表的列的同时也会指定自定义的SerDe,Hive通过SerDe确定表的具体的列的数据。

SerDe是Serialize/Deserilize的简称, hive使用Serde进行行对象的序列与反序列化。

(8)STORED AS指定存储文件类型

常用的存储文件类型:SEQUENCEFILE(二进制序列文件)、TEXTFILE(文本)、RCFILE(列式存储格式文件)

如果文件数据是纯文本,可以使用STORED AS TEXTFILE。如果数据需要压缩,使用 STORED AS SEQUENCEFILE。

(9)LOCATION :指定表在HDFS上的存储位置。

(10)AS:后跟查询语句,根据查询结果创建表。

(11)LIKE允许用户复制现有的表结构,但是不复制数据。

管理表

默认创建的表都是所谓的管理表,有时也被称为内部表。因为这种表,Hive会(或多或少地)控制着数据的生命周期。Hive默认情况下会将这些表的数据存储在由配置项hive.metastore.warehouse.dir(例如,/user/hive/warehouse)所定义的目录的子目录下。 当我们删除一个管理表时,Hive也会删除这个表中数据。管理表不适合和其他工具共享数据。

1.普通创建表

create table if not exists student2(

id int, name string

)

row format delimited fields terminated by '\t'

stored as textfile

location '/user/hive/warehouse/student2';

(2)根据查询结果创建表(查询的结果会添加到新创建的表中)

hive (default)> create table if not exists student3 as select id , name from student;

(3)根据已经存在的表结构创建表

hive (default)> create table if not exists student4 like student;

(4)查询表的类型

hive (default)> desc formatted student2;

OK

col_name data_type comment

# col_name data_type comment

id int

name string

# Detailed Table Information

Database: default

Owner: root

CreateTime: Sun Oct 20 08:03:29 CST 2019

LastAccessTime: UNKNOWN

Protect Mode: None

Retention: 0

Location: hdfs://mycluster/user/hive/warehouse/student2

Table Type: MANAGED_TABLE

Table Parameters:

transient_lastDdlTime 1571529809

# Storage Information

SerDe Library: org.apache.hadoop.hive.serde2.lazy.LazySimpleSerDe

InputFormat: org.apache.hadoop.mapred.TextInputFormat

OutputFormat: org.apache.hadoop.hive.ql.io.HiveIgnoreKeyTextOutputFormat

Compressed: No

Num Buckets: -1

Bucket Columns: []

Sort Columns: []

Storage Desc Params:

field.delim \t

serialization.format \t

Time taken: 0.089 seconds, Fetched: 28 row(s)

外部表

因为表是外部表,所以Hive并非认为其完全拥有这份数据。删除该表并不会删除掉这份数据,不过描述表的元数据信息会被删除掉。

管理表和外部表的使用场景

每天将收集到的网站日志定期流入HDFS文本文件。在外部表(原始日志表)的基础上做大量的统计分析,用到的中间表、结果表使用内部表存储,数据通过SELECT+INSERT进入内部表。

案例实操

分别创建部门和员工外部表,并向表中导入数据。

1 xiaoming

2 wangfeng

3 lijie

4 liuliu

hive (default)> dfs -mkdir /tmp/student;

hive (default)> dfs -put /tmp/student.txt /tmp/student;

创建外部表

hive (default)> create external table stu_external(

id int,

name string)

row format delimited fields terminated by '\t'

location '/tmp/student';

查看创建的表

hive (default)> select * from stu_external;

OK

stu_external.id stu_external.name

1 xiaoming

2 wangfeng

3 lijie

4 liuliu

查看表格式化数据

hive (default)> desc formatted stu_external;

OK

col_name data_type comment

# col_name data_type comment

id int

name string

# Detailed Table Information

Database: default

Owner: root

CreateTime: Sun Oct 20 08:17:57 CST 2019

LastAccessTime: UNKNOWN

Protect Mode: None

Retention: 0

Location: hdfs://mycluster/tmp/student

Table Type: EXTERNAL_TABLE

Table Parameters:

COLUMN_STATS_ACCURATE false

EXTERNAL TRUE

numFiles 0

numRows -1

rawDataSize -1

totalSize 0

transient_lastDdlTime 1571530677

# Storage Information

SerDe Library: org.apache.hadoop.hive.serde2.lazy.LazySimpleSerDe

InputFormat: org.apache.hadoop.mapred.TextInputFormat

OutputFormat: org.apache.hadoop.hive.ql.io.HiveIgnoreKeyTextOutputFormat

Compressed: No

Num Buckets: -1

Bucket Columns: []

Sort Columns: []

Storage Desc Params:

field.delim \t

serialization.format \t

Time taken: 0.077 seconds, Fetched: 34 row(s)

删除外部表

hive (default)> drop table stu_external;

外部表删除后,hdfs中的数据还在,但是metadata中stu_external的元数据已被删除

管理表与外部表的互相转换

(1)查询表的类型

hive (default)> desc formatted student2;

Table Type: MANAGED_TABLE

(2)修改内部表student2为外部表

alter table student2 set tblproperties('EXTERNAL'='TRUE');

(3)修改外部表student2为内部表

hive (default)> alter table student2 set tblproperties('EXTERNAL'='FALSE');

注意:(‘EXTERNAL’=‘TRUE’)和(‘EXTERNAL’=‘FALSE’)为固定写法,区分大小写!

分区表

分区表实际上就是对应一个HDFS文件系统上的独立的文件夹,该文件夹下是该分区所有的数据文件。Hive中的分区就是分目录,把一个大的数据集根据业务需要分割成小的数据集。在查询时通过WHERE子句中的表达式选择查询所需要的指定的分区,这样的查询效率会提高很多。

分区表基本操作

创建分区表

create table stu_partition

( id int,name string) partitioned by (month string)

row format delimited fields terminated by '\t';

注意:分区字段不能是表中已经存在的数据,可以将分区字段看作表的伪列。

加载数据到分区表中

hive (default)> load data local inpath '/tmp/student.txt' overwrite into table stu_partition partition(month='201810');

hive (default)> load data local inpath '/tmp/student.txt' overwrite into table stu_partition partition(month='201812');

注意:overwrite是覆盖,into是追加,分区表加载数据时,必须指定分区

单分区查询

select * from stu_partition where month='201811';

多分区联合查询

会生成mr作业

hive (default)> select * from stu_partition where month='201811' union select * from stu_partition where month='201810'

增加分区

创建单个分区

hive (default)> alter table stu_partition add partition(month='201910');

创建多个分区

直接在后面partition(分区字段=‘属性’)

hive (default)> alter table stu_partition add partition(month='201912') partition(month='201911');

删除分区

删除单个分区

hive (default)> alter table stu_partition drop partition(month='201910');

删除多个分区

hive (default)> alter table stu_partition drop partition(month='201912'), partition(month='201911');

删除的时候有,号

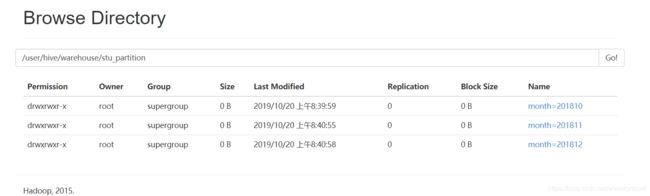

查看分区

查看表有多少分区

hive (default)> show partitions stu_partition;

OK

partition

month=201810

month=201811

month=201812

查看表结构

其中

hive (default)> desc formatted stu_partition;

#Partition Information

#col_name data_type comment

month string

分区表注意事项

1.创建二级分区表

create table stu_partition2(id int,name string)

partitioned by(month string,day string)

row format delimited fields terminated by '\t';

2.正常的加载数据

(1)加载数据到二级分区表中

hive (default)> load data local inpath '/tmp/student.txt' into table stu_partition2 partition(month='201908',day='11');

(2)查询分区数据

hive (default)> select * from stu_partition2 where month='201908' and day='11';

3.把数据直接上传到分区目录上,让分区表和数据产生关联的三种方式

(1)方式一:上传数据后修复

上传数据

hive (default)> dfs -mkdir -p /user/hive/warehouse/stu_partition2/month=201909/day=12;

hive (default)> dfs -put /tmp/student.txt /user/hive/warehouse/stu_partition2/month=201909/day=12;

查询数据(查询不到刚上传的数据)

hive (default)> select * from stu_partition2 where month='201909' and day='12';

OK

stu_partition2.id stu_partition2.name stu_partition2.month stu_partition2.day

Time taken: 0.066 seconds

执行修复命令

hive (default)> msck repair table stu_partition2;

温馨提示:如果有人删线上数据,集群配置了回收站,可以采用这样方式修复数据

(2)方式二:上传数据后添加分区

上传数据

hive (default)> dfs -mkdir -p /user/hive/warehouse/stu_partition2/month=201909/day=11;

hive (default)> dfs -put /tmp/student.txt /user/hive/warehouse/stu_partition2/month=201909/day=11;

查询数据

hive (default)> select * from stu_partition2 where month='201909' and day='11';

OK

stu_partition2.id stu_partition2.name stu_partition2.month stu_partition2.day

1 xiaoming 201909 11

2 wangfeng 201909 11

3 lijie 201909 11

4 liuliu 201909 11

(3)方式三:创建文件夹后load数据到分区

load data local inpath '/tmp/student.txt' into table stu_partition2 partition(month='201910',day='22');

查询有数

hive (default)> select * from stu_partition2 where month='201910' and day='22';

修改表

重命名表

1.语法

ALTER TABLE table_name RENAME TO new_table_name

2.实操案例

hive (default)> alter table stu_partition2 rename to stu_partition3;

增加/修改/替换列信息

1.语法

更新列

ALTER TABLE table_name CHANGE [COLUMN] col_old_name col_new_name column_type [COMMENT col_comment] [FIRST|AFTER column_name]

增加和替换列

ALTER TABLE table_name ADD|REPLACE COLUMNS (col_name data_type [COMMENT col_comment], ...)

注:ADD是代表新增一字段,字段位置在所有列后面(partition列前),REPLACE则是表示替换表中所有字段。

2.实操案例

添加列

hive (default)> alter table stu_partition3 add columns (class string);

更新列

修改class字段为home并且为string类型

hive (default)> alter table stu_partition3 change column class home string;

替换列

hive (default)> alter table stu_partition3 replace columns(home string,loc string);

删除表

hive (default)> drop table stu_partition3;

– note by 张不帅 2019-10-23 0:10 ( ̄o ̄) . z Z