集成学习打卡学习记录(Datawhale)

一、了解机器学习

开源文档: 开源

1.1 什么是机器学习?

感觉文章学习文档总结的很精炼也特别容易理解:机器学习的一个重要的目标就是利用数学模型来理解数据,发现数据中的规律,用作数据的分析和预测。

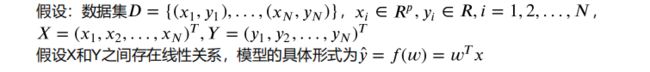

数据通常是由向量组成。我们用 x i x_i xi来表示一个样本,其中 i = 1 , 2 , 3 , . . . , N i=1,2,3,...,N i=1,2,3,...,N,共N个样本,每个样本 x i = ( x i 1 , x i 2 , . . . , x i p , y i ) x_i=(x_{i1},x_{i2},...,x_{ip},y_i) xi=(xi1,xi2,...,xip,yi)共p+1个维度,前p个维度的每个维度我们称为一个特征,最后一个维度 y i y_i yi我们称为因变量(响应变量)。特征用来描述影响因变量的因素,如:我们要探寻身高是否会影响体重的关系的时候,身高就是一个特征,体重就是一个因变量。通常在一个数据表dataframe里面,一行表示一个样本 x i x_i xi,一列表示一个特征。

根据数据是否有因变量,机器学习的任务可分为:有监督学习和无监督学习。

- 有监督学习:给定某些特征去估计因变量,即因变量存在的时候,我们称这个机器学习任务为有监督学习。如:我们使用房间面积,房屋所在地区,环境等级等因素去预测某个地区的房价。

- 无监督学习:给定某些特征但不给定因变量,建模的目的是学习数据本身的结构和关系。如:我们给定某电商用户的基本信息和消费记录,通过观察数据中的哪些类型的用户彼此间的行为和属性类似,形成一个客群。注意,我们本身并不知道哪个用户属于哪个客群,即没有给定因变量。

根据因变量的是否连续,有监督学习又分为回归和分类:

- 回归:因变量是连续型变量,如:房价,体重等。

- 分类:因变量是离散型变量,如:是否患癌症,西瓜是好瓜还是坏瓜等。

tips:机器学习使用的工具包位sklearn(scikit-learn)

1.2 机器学习相关分类回归任务及工具包使用

如下代码主要用作画图,seaborn是基于Matplotlib的Python数据可视化库,它提供了一个高级界面,用于绘制引人入胜且内容丰富的统计图形,只是在Matplotlib上进行了更高级的API封装,从而使作图更加容易。

# 引入相关科学计算包

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

%matplotlib inline

plt.style.use("ggplot")

import seaborn as sns

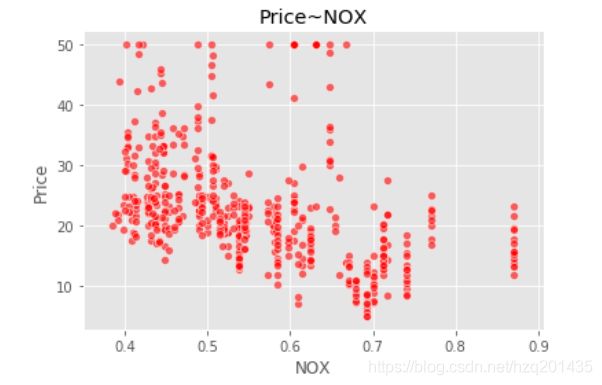

加载boston放假预测数据集,并可视化展示

from sklearn import datasets

boston = datasets.load_boston() # 返回一个类似于字典的类

X = boston.data

y = boston.target

features = boston.feature_names

boston_data = pd.DataFrame(X,columns=features)

boston_data["Price"] = y

boston_data.head()

sns.scatterplot(boston_data['NOX'],boston_data['Price'],color="r",alpha=0.6)

plt.title("Price~NOX")

plt.show()

特征解释:

CRIM:各城镇的人均犯罪率

ZN:规划地段超过25,000平方英尺的住宅用地比例

INDUS:城镇非零售商业用地比例

CHAS:是否在查尔斯河边(=1是)

NOX:一氧化氮浓度(/千万分之一)

RM:每个住宅的平均房间数

AGE:1940年以前建造的自住房屋的比例

DIS:到波士顿五个就业中心的加权距离

RAD:放射状公路的可达性指数

TAX:全部价值的房产税率(每1万美元)

PTRATIO:按城镇分配的学生与教师比例

B:1000(Bk - 0.63)^2其中Bk是每个城镇的黑人比例

LSTAT:较低地位人口

Price:房价

因为y是连续,故它是一个回归模型

1.3 分类

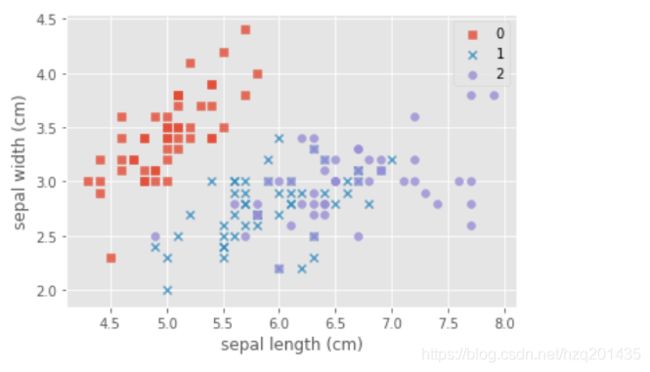

这里使用鸢尾花数据集:Iris 鸢尾花数据集是一个经典数据集,在统计学习和机器学习领域都经常被用作示例。数据集内包含 3 类共 150 条记录,每类各 50 个数据,每条记录都有 4 项特征:花萼长度、花萼宽度、花瓣长度、花瓣宽度,可以通过这4个特征预测鸢尾花卉属于(iris-setosa, iris-versicolour, iris-virginica)中的哪一品种。

# 查看数据

from sklearn import datasets

iris = datasets.load_iris()

X = iris.data

y = iris.target

features = iris.feature_names

iris_data = pd.DataFrame(X,columns=features)

iris_data['target'] = y

iris_data.head()

# 可视化特征

marker = ['s','x','o']

# np.unique()除去重复数字后排序输出

for index,c in enumerate(np.unique(y)):

plt.scatter(x=iris_data.loc[y==c,"sepal length (cm)"],y=iris_data.loc[y==c,"sepal width (cm)"],alpha=0.8,label=c,marker=marker[c])

plt.xlabel("sepal length (cm)")

plt.ylabel("sepal width (cm)")

plt.legend()

plt.show()

1.4 无监督学习数据集的生成

# 生成月牙型非凸集

from sklearn import datasets

# datasets.make_moons

# 作样本数据,产生的结果为一个简单的样本数据集,用于可视化聚类算法和分类算法

x, y = datasets.make_moons(n_samples=2000, shuffle=True,

noise=0.05, random_state=None)

for index,c in enumerate(np.unique(y)):

plt.scatter(x[y==c,0],x[y==c,1],s=7)

plt.show()

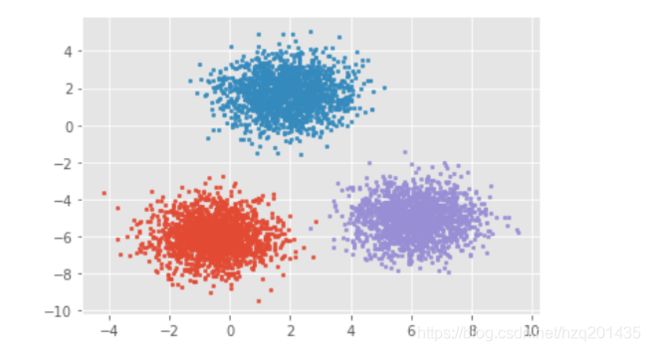

# 生成符合正态分布的聚类数据

from sklearn import datasets

x, y = datasets.make_blobs(n_samples=5000, n_features=2, centers=3)

for index,c in enumerate(np.unique(y)):

plt.scatter(x[y==c, 0], x[y==c, 1],s=7)

plt.show()

二、使用sklearn构建完整机器学习项目

构建机器学习项目的步骤:

- 明确任务是回归还是分类

- 收集数据并选取合适特征

- 选择度量模型的指标

- 选择具体模型

- 评估模型性能并调参

2.1 用sklearn构建完整项目

- 收集数据

采用boston房价预测数据集

# 加载数据集

from sklearn import datasets

boston = datasets.load_boston() # 返回一个类似于字典的类

X = boston.data

y = boston.target

features = boston.feature_names

boston_data = pd.DataFrame(X,columns=features)

boston_data["Price"] = y

boston_data.head()

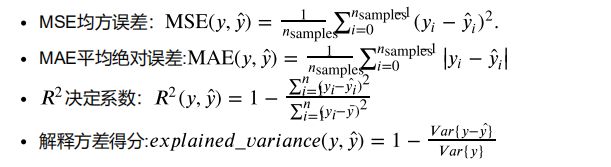

2、指标

3、因为房价是连续的所以采用线性回归模型

简单的线性回归模型如下:

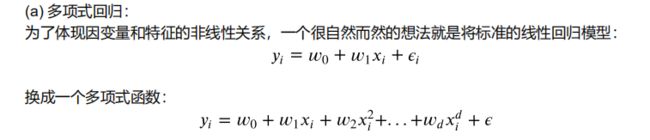

但当数据存在非线性关系时,我们使用线性回归模型进行预测会导致预测性能极其低下,因为模型的形式本身是线性的,无法表达数据中的非线性关系。我们一个很自然的想法就是去推广线性回归模型,使得推广后的模型更能表达非线性的关系。

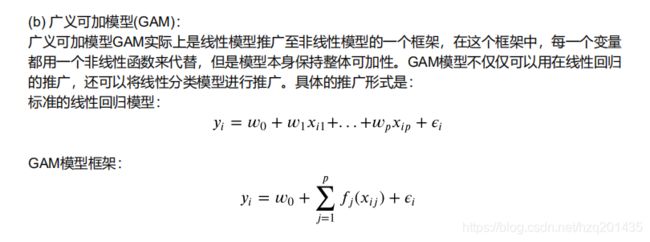

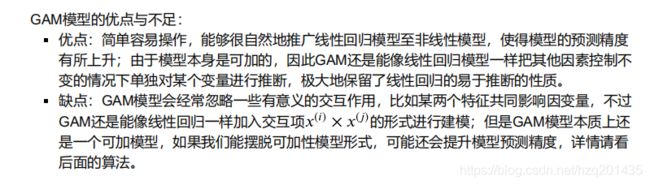

广义可加模型定义:

回归树、支持向量机回归占位。。

4、优化基础模型

- 过拟合:当我们的模型的训练均方误差达到很小时,测试均方误差反而很大,但是我们寻找的最优的模型是测试均方误差达到最小时对应的模型,因此基于训练均方误差达到最小选择模型本质上是行不同的。正如上右图示:模型在训练误差很小,但是测试均方误差很大时,我们称这种情况叫模型的过拟合。

- 偏差方差: 一般来说,模型的复杂度越高,f的方差就会

越大。另一方面,模型的偏差是指:为了选择一个简单的模型去估计真实函数所带入的误差。“偏差-方差分解”说明:泛化性能是由学习算法的能力、数

据的充分性以及学习任务本身的难度所共同决定的。给定学习任务,为了取得好的泛化性能,则需使偏差较小,即能够充分拟合数据,并且使方差较小,即使得数据扰动产生的影响小。 - 训练误差修正与交叉验证改善偏差方差

- 正则化

- 降维

5、调参

网格法调整超参数

优化模型基础

问题的引出:我们可以在训练集上使损失函数的值为0,但是在测试集上面不见得有如此好的表现

训练均方差与测试均方差

当我们的模型的训练均方误差达到很小时,测试均方误差反而很大,但是我们寻找的最优的模型是测试均方误差达到最小时对应的模型,因此基于训练均方误差达到最小选择模型本质上是行不同的。模型在训练误差很小,但是测试均方误差很大时,我们称这种情况叫模型的过拟合。

偏差和方差权衡

测试均方误差的期望值可以分解为 f(xo)-hat的方差、f(xo)-hat 的偏差平方和E误差项的方差。

![]()

一般来说,模型的复杂度越高,f的方差就会越大。 如加入二次项的模型的方差比线性回归模型的方差要大。模型的偏差是指:为了选择一个简单的模型去估计真实函数所带入的误差。

-

偏差度量了学习算法的期望预测与真实结果的偏离程度,即刻画了算法本身的拟合能力。

-

方差度量了同样大小的训练集的变动所导致的学习性能变化,即刻画了数据扰动所造成的影响。

-

噪声则表达了在当前任务上任何学习算法所能达到的期望泛化误差的下界,即刻画了学习问题本身的难度。