TensorFlow实战(2):自编码器的实现

自编码器原理

自编码器也是一种神经网络,输入和输出一致,可以使用自身的高阶特征编码自己,借助系数编码的思想,目标使用稀疏的一些高阶特征重新组合来重构自己。为了达到此目标,使用以下方法:

(1)限制中间隐含层的节点的数量,相当于一个降维的过程。

(2)给数据加入噪声(去噪自编码器),编码器将从噪声中学习数据的特征,则不可能完全复原原始数据。

代码详解

import numpy as np

import sklearn.preprocessing as prep

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

#参数初始化,根据某一层网络的输入,输出节点数量自动调整最合适的分布

#fan_in,fan_out分别为输入/出节点的个数

#让权重分布满足均值为0, 方差为2/(fan_in + fan_out)

def xavier_init(fan_in, fan_out, constant = 1):

low = -constant * np.sqrt(6.0 / (fan_in + fan_out))

high = constant * np.sqrt(6.0 / (fan_in + fan_out))

#random_uniforim为(min,max)的均匀分布

return tf.random_uniform((fan_in, fan_out), minval = low, maxval = high, dtype = tf.float32)

#定义一个自编码器的类

class AdditiveGaussianNoiseAutoencoder(object):

def __init__(self, n_input, n_hidden, transfer_function = tf.nn.softplus,

optimizer = tf.train.AdamOptimizer(), scale = 0.1):

self.n_input = n_input #输入变量数

self.n_hidden = n_hidden #隐含层的节点数

self.transfer = transfer_function #隐含层激活函数,默认为softplus

self.scale = tf.placeholder(tf.float32) #高斯噪声系数

self.training_scale = scale

network_weights = self._initialize_weights() #初始化网络参数

self.weights = network_weights

self.x = tf.placeholder(tf.float32, [None, self.n_input]) #输入

#隐含层的输出,先给输入x加上噪声,再用matmul将加上噪声后输入与w1相乘,并加上偏置,最后用transfer进行激活函数处理

self.n_hidden = self.transfer(tf.add(tf.matmul(self.x + scale * tf.random_normal((n_input,)),

self.weights['w1']), self.weights['b1']))

#将隐含层的输出乘w2,再加上b2

self.reconstruction = tf.add(tf.matmul(self.n_hidden, self.weights['w2']), self.weights['b2'])

#损失函数使用平方误差

self.cost = 0.5 * tf.reduce_sum(tf.pow(tf.subtract(self.reconstruction, self.x), 2.0))

self.optimizer = optimizer.minimize(self.cost) #定义优化器对损失值进行优化

init = tf.global_variables_initializer() ##使用TensorFlow的全局参数初始化器

self.sess = tf.Session()

self.sess.run(init)

#初始化参数

def _initialize_weights(self):

all_weights = dict() #存放参数的字典

#w1参数使用xavier方式使用合适的初始化参数,其余直接初始化为0

all_weights['w1'] = tf.Variable(xavier_init(self.n_input, self.n_hidden))

all_weights['b1'] = tf.Variable(tf.zeros([self.n_hidden], dtype = tf.float32))

all_weights['w2'] = tf.Variable(tf.zeros([self.n_hidden, self.n_input], dtype = tf.float32))

all_weights['b2'] = tf.Variable(tf.zeros([self.n_input], dtype = tf.float32))

return all_weights

#计算cost并执行一步训练

def partial_fit(self, X):

cost, opt = self.sess.run((self.cost, self.optimizer), feed_dict= {self.x : X, self.scale : self.training_scale})

return cost

#计算cost

def calc_total_cost(self, X):

return self.sess.run(self.cost, feed_dict={self.x: X, self.scale : self.training_scale})

'''

#返回自编码器隐含层的输出结果

def transform(self, X):

return self.sess.run(self.hidden, feed_dict={self.x: X, self.scale : self.training_scale})

#将隐含层提取到的高阶特征复原

def generate(self, hidden = None):

if hidden is None:

hidden = np.random.normal(size = self.weights['b1'])

return self.sess.run(self.reconstruction, feed_dict={self.n_hidden: hidden})

#整体运行一遍复原过程(提取高阶特征+复原数据)

def reconstruct(self, X):

return self.sess.run(self.reconstruction, feed_dict={self.x:X, self.scale:self.training_scale})

#获得隐含层的权重w1

def getWeights(self):

return self.sess.run(self.weights['w1'])

#获得隐含层偏置系数b1

def getBiases(self):

return self.sess.run(self.weights['b1'])

'''

mnist = input_data.read_data_sets('MNIST_data', one_hot=True) #载入mnist数据

#对数据进行标准化处理,让数据变成均值为0,标准差为1的分布, 减去均值,再除以标准差

#直接调用sklearn中的类实现

def standard_scale(X_train, X_test):

preprocessor = prep.StandardScaler().fit(X_train) #计算训练集的均值,标准差

#用训练集的均值,标准差对训练集和测试集进行标准化处理,注意不可以使用测试集的相关数据进行标准化处理

X_train = preprocessor.transform(X_train)

X_test = preprocessor.transform(X_test)

return X_train, X_test

#对训练集,测试集标准化处理

X_train, X_test = standard_scale(mnist.train.images, mnist.test.images)

#获取随机block数据的函数

def get_random_block_from_data(data, batch_size):

start_index = np.random.randint(0, len(data) - batch_size)

return data[start_index : (start_index + batch_size)]

n_samples = int(mnist.train.num_examples) #总训练的样本数

training_epochs = 20 #最大训练轮数

batch_size = 128 #每轮迭代次数

display_step = 1 #每个1次显示loss

#创建AGN自编码器的实例

autoencoder = AdditiveGaussianNoiseAutoencoder(n_input=784, n_hidden=200,

transfer_function=tf.nn.softplus,

optimizer=tf.train.AdamOptimizer(learning_rate=0.001),

scale=0.01)

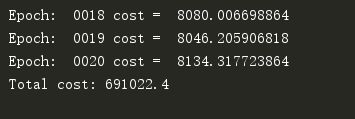

for epoch in range(training_epochs):

avg_cost = 0. #平均损失

total_batch = int(n_samples / batch_size) #总共需要的batch数

for i in range(total_batch):

batch_xs = get_random_block_from_data(X_train, batch_size) #随机获取训练集中batch_size个的数据

cost = autoencoder.partial_fit(batch_xs) #执行一步训练

avg_cost += cost / n_samples * batch_size

if epoch % display_step == 0:

print("Epoch: ", '%04d' % (epoch + 1), "cost = ", "{:.9f}".format(avg_cost))

print("Total cost: " + str(autoencoder.calc_total_cost(X_test)))